编辑:编辑部

【新智元导读】谁能想到,GPT-4都晋升「版主」了,人类要审核几个月的东西,它几个小时就可以搞定了!人类审核员恐将迎来大面积失业?

在GPT-4公开的四个月后,OpenAI开发了一种方法,可以使用GPT-4进行内容审核了!人类几个月的工作,它几小时就能完成。

此消息一出,立马登上知乎热搜。

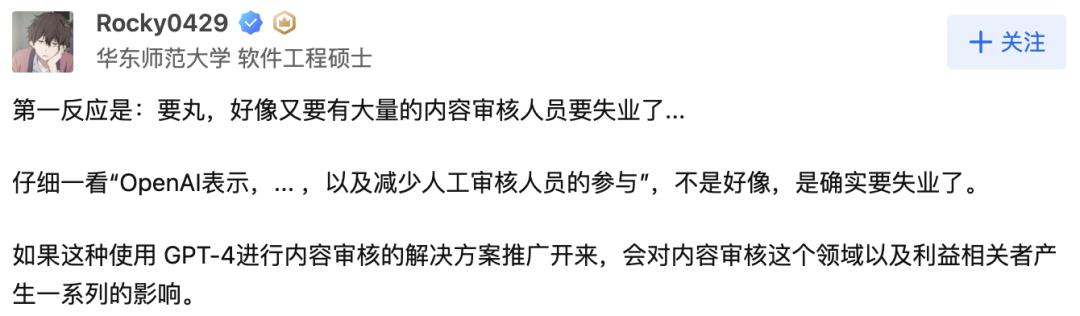

网友纷纷表示:药丸,人类这次是真的要失业了。

人类在上网过程中产生的不适宜内容,可以被GPT-4判别出来,一举拿下。

GPT-4审核官「养成记」

对于GPT-4,你可以直接告诉它具体的内容政策,比如不要任何涉及暴力以及非暴力的错误行为,以及采购武器的信息。

这个循环会一直重复,直到模型的判断和专家一致。

整个过程是迭代的,速度很快。每次迭代后,GPT-4都会变得更加适应政策的细微差别。

迭代过程会生成转换为分类器的优化内容政策,因此能够大规模地部署对政策和内容的审查。

使用GPT-4进行内容审核的过程:从政策制定到大规模审核

这次,真不用人类了

利用人工智能进行内容审核,这个简单而强大的想法为传统的内容审核方法提供了一些改进:

首先是更加一致的标注。由于内容政策在不断发展,条例变得越来越多。

就像有一千个读者就有一千个哈姆雷特那样,人们对这些繁杂条例的理解也会有偏差。

但GPT-4 可以将这一过程缩短到几个小时。不仅大大减小了人工审核的滞后性,还能更快地应对新的危害漏洞。

最后一个好处是减轻人类的心理负担。持续接触有害或冒犯性的内容会导致人类审核员产生情感麻木以及心理压力。

内容审核员面临着极高的各类精神疾病风险,同时三班倒工作时间和低微的薪水与没有上升空间的职业道路,让担任内容审核的人类自嘲自己和「机器」一样。

如果让真正的机器来担任这类工作,将有利于相关人员的福祉,毕竟我们应该不太用担心,大量接触不良信息会让GPT模型心理崩溃。

GPT-4的标记质量类似于经过轻度训练的人工版主(B 组)。不过,两者都被经验丰富、训练有素的人类主持人(A 组)超越了

跟Constitutional AI(依赖于模型自己判断是否安全)相比,OpenAI的这个方法可以让基于平台的特定内容政策迭代更快、更省力。

OpenAI表示鼓励安全从业者都尝试这个过程进行审核,只要有OpenAI的API访问权限就行。

OpenAI还在尝试,通过结合思维链推理或者自我批评,来提高GPT-4的预测质量。

另外他们也在尝试检测未知风险的方法,以及利用模型来识别潜在的有害内容,并对其进行高级的描述(也是受Constitutional AI)的启发。

这些发现也会为全新的风险政策提供信息。

当然,GPT-4也会在训练期间出现偏差,这个过程中还需要人类来监控、验证和完善。而节省的人力,可以用来专注于解决政策需要最需要的复杂边缘情况。

知友:看好这类应用场景

知友「多头注意力」表示,这不是GPT的新功能了,但的确是很不错的场景化产品开发方向。AIGC实践中,大家的确会拿GPT又当矛又当盾。

因此他不建议去做审核,因为这本质上就是一个数据打桩师的工作。

这位知友预测,如果人类审核员的工作可以被替代,那大概率会计、高速收费员、银行柜员都可以消失了。

但也有知友认为,不必太焦虑,人工审核永远不会被AI替代。许多内容机器未必能识别出来,而在内容领域,安全合规要大于一切。

另外,OpenAI会不会存储或二次使用内容,安全性如何保证,都是个问题。

OpenAI的愿景是,「随着内容规模的不断扩大,由人类引导的AI可以创造一个更安全的世界。」

AI真的能帮我们创造一个更安全、更无害的世界吗?目前看来,至少这个画面很美好。

参考资料:

https://www.zhihu.com/question/617524795

https://x.com/openai/status/1691498818343460864?s=46&t=iBppoR0Tk6jtBDcof0HHgg

相关文章

猜你喜欢