我们来看下OpenAI的定价策略。

自由探索Explore版 (我等):可以免费使用3个月,或者10万token,哪个先到按哪个算,占着不用可不行。

Create版(普通用户): 100美元一个月,200万token每月,超出的部分1k token按8美分计算;

Build版(VIP): 400美元一个月,1000万token每月,超出的部分1k token按6美分计算;

Scale版(尊享版):如果你是也就是生产级的大规模用户,联系官方就好,有专人服务。

这个200万token,能有多少字呢?大约相当于3000页的文本。

这样说可能还是不直接,举个例子,莎士比亚全集是大约有90万个单词,折算到token的话大概能有120万。

当前OpenAI实行的是邀请制,只有被邀请的用户才能进行测试,没有邀请的仍需等待到10月1日再付费。

我有自己的业务场景,想微调一下模型,可否?

有钱,可以,没钱,不行。微调目前只向 Scale 定价层的客户开放。

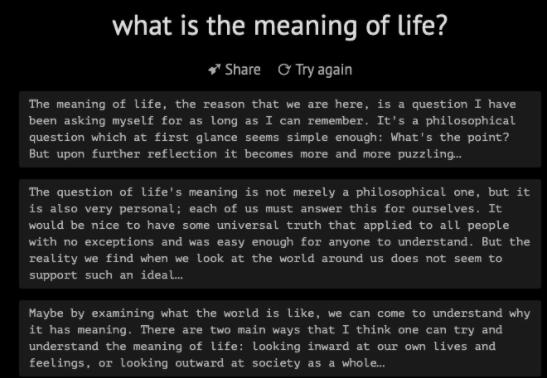

前面我们介绍过一个哲学家AI,就是利用了GPT-3的测试API。

这个应用发布后,引来大批网友围观。目前有大约750,000个查询,有一半的问题成功调用了GPT-3的API,它的回答还蛮有哲学味的。

我们假设产生了400,000个输出,平均每个1000个token,两到三个星期就有4亿token,这样PhilosopherAI一个月就要花4000美元,这只是个娱乐项目啊,作者表示「溜了溜了」。

大家还是很担心,这么贵的API能创造收益么?

不过,真有愿意付费的,GPT-3的代码自动补全还是能释放出极大的生产力。

还有非结构化文本的信息提取,如果这次放开的API可以提供这种能力,相信很多人愿意用的。

比如下面这种应用,从PDF中提取结构化的表格信息。

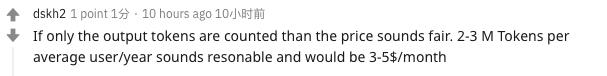

现在的方案,是同时计算输入和输出的,OpenAI的口号是「text in,text out」,但是在这种定价方法下,成了「money in ,money out」,希望OpenAI考虑下只计算输出部分,这样一个月花几美元,就在普通用户的承受范围了。

终于还是收费,为什么OpenAI现在不open了?

GPT-3如此强大,开发者们又怎会放弃这么好的机会,大家早已使用API开发出了各种神奇的功能。

GPT-3可以在英语和Shell命令之间互译:

甚至有一位网友,给GPT-3出了几道代码题,在Ruby语言下实现某种功能,GPT-3轻松搞定,难道未来的电话面试,要首先确定对方是不是AI了吗?

OpenAI决定发布商业版

GPT-3的训练费用已经达到了惊人的1200万美元,即便是背靠埃隆马斯克和微软,数千万的训练费用和持续的研发投入也是一笔不小的费用,开放商业版API可以覆盖「完成使命过程中的成本」,现在没钱的都不配拥有使命感了吗。。

同时,OpenAI还认为安全地部署AI系统是很难的,希望通过和各种商业伙伴的合作,来观察在各行各业会产生怎样有意思的产品,同时保证产品的安全性。

在接受了微软投资的10亿美元后,OpenAI的商业化也必须加快脚步。

依靠巨大的算力资源才能跑出来的模型不能只做一些简(qi)单(pa)的demo,毕竟投资本身是商业活动,而不是慈善。

开放API而不是模型

首先,OpenAI希望通过API方式来推动GPT-3的技术商业化,未来在安全可靠、政策合规的基础上进行相关AI产品的开发,并实现商业化的盈利。

其次,这款API背后的模型异常的庞大,不仅需要很多研究人员来开发和部署,训练和运行的费用也十分昂贵,这种高昂的成本会将很多科研人员和创业公司拒之门外,从而成为大公司的专属。

开放API将使得更多的小微企业、开发者等都能平等的享受到GPT-3的红利。

最后,如果模型开源,则无法监测下游任务如何使用模型,一旦有人在此基础上开发带有危险性的应用程序,官方将很难制止。通过API方式就可以很好应对人们对技术的滥用。

具体开放功能话,GPT-3可以在语义搜索、聊天机器人、生产力工具、文本生成、内容理解、机器翻译等方面进行商业化应用。

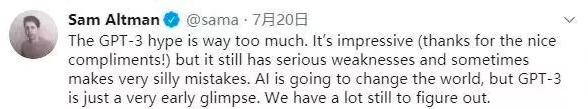

GPT-3的商业化进程并不是一帆风顺,OpenAI的联合创始人就表示:GPT-3被吹得有些过头了。

GPT-3目前还是会出现一些低级错误和尬聊,甚至偶尔带有歧视和偏见性内容,而这些都会让企业对GPT-3的商业化产生担忧。

同时,GPT-3的性价比不是最优的。虽然这是一个「大而全」的通用性模型,但是在具体下游任务却可能输给「小而美」的模型。

但是,如果你坚持要感受一把「使命感」,交出你的钱包就行!

相关文章

猜你喜欢