谁能想到,一场泄密事件,竟成了引发“ChatGPT平替”狂潮的开端。

事情的最开端,是在今年2月24日,Meta发布大语言模型LLaMA(中文意为“羊驼”),因其参数量远小于GPT-3,效果却仍能优于后者一度在圈内引起热议。

当然,与近些年的大模型研发趋势一样,虽然Meta声称LLaMA是开源的,但仍需要研究人员申请并进行审核。

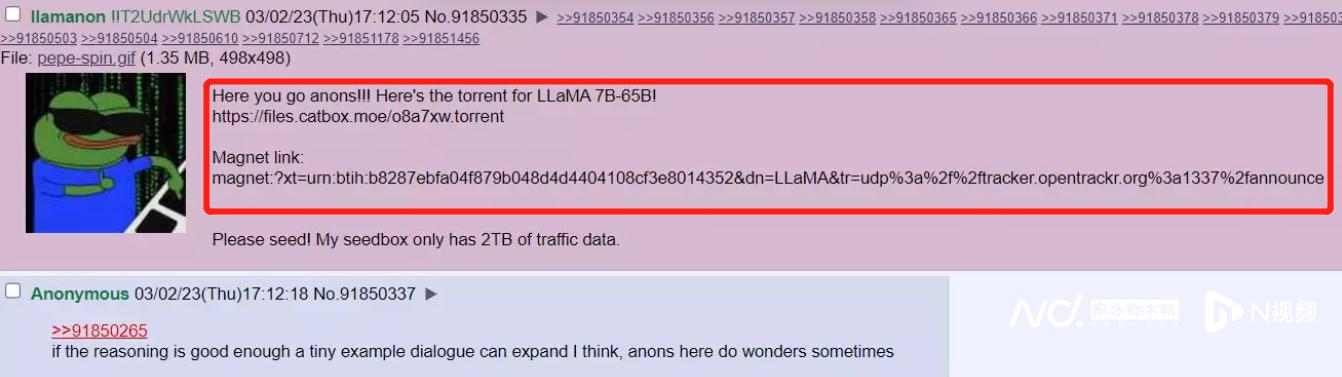

但在一周之后,日本论坛4chan(相当于国内贴吧)上却突然出现一条帖子,上传了一个LLaMA模型源代码的种子文件,下载后大小约为219G,瞬间一石激起千层浪,下载量很快超越千次。

更有戏剧性的是,这个种子链接还被合并到了LLaMA的官方GitHub页面,甚至还得到了部分项目维护者的批准,真的可以“点击即用”。此后,4chan上还有用户为那些希望自主部署该模型的人提供了详细教程,说明了如何获得模型,如何添加修改后的模型,如何进行更有效的推理等等。

对此,Meta官方在3月6日称,仍将继续向通过审核的研究人员给予LLaMA官方通道,同时,也开始着手控制LLaMA泄露源代码的传播。之后,开源AI平台Hugging Face的CEO就曾站出来表示,禁止用户上传LLaMA泄露源代码。

但接下来,这场“史诗级泄露事件”的火,却烧到了令人意想不到的方向——

3月15日,斯坦福发布语言大模型Alpaca,模型由LLaMA微调而来,仅用了52k数据,其性能约等于GPT-3.5,且训练成本还不到600美元。

3月23日,AI公司Nebuly开源了基于LLaMA的模型ChatLLama,允许用户基于预训练的LLaMA模型构建个性化的ChatGPT服务,且训练速度更快,成本更低。

3月29日,加州大学伯克利分校在其Colossal-AI项目下发布了ColossalChat,这一模型通过RLHF(一种强化学习方式,类似于奖励机制),基于LLaMA预训练模型提供了ChatGPT服务。

同天,AI公司Age of AI推出了语言模型FreedomGPT,其基于斯坦福的Alpaca进行开发,号称是去掉了安全、伦理道德过滤器的ChatGPT版本。

3月31日,加州大学伯克利分校、卡内基梅隆大学、斯坦福大学和加州大学圣地亚哥分校的研究人员开源了语言模型Vicuna,这是一个与GPT-4性能相近的LLama的微调版本,训练成本仅有300美元。

4月3日,伯克利的伯克利人工智能研究院(BAIR)发布了 Koala,这一模型同样是一种微调过的LLama版本,在超过一半的情况下与ChatGPT性能相当。

大批LLaMA类研发的推出与LLaMA模型的源代码泄露到底有无直接关系,不得而知。但无论如何,以LLaMA模型“被迫”开源为关键时间点,基于它开发的模型与服务,开始了爆炸式的增长。

有趣的是,似乎是为了呼应最初Meta家的LLaMA模型的一种含义“大羊驼”,之后斯坦福选择了相似含义的Alpaca(羊驼),之后又出现了Vicuna(小羊驼)……对此,有人调侃,再开发下去,“羊驼家族”的名字都快不够用了。

对此,有人笑称这场泄露事件促进了大批ChatGPT式服务的产生,甚至促进了AI民主化,可谓大功一件;也有人表示最初的泄露本就是Meta的“自导自演”,为的是最大限度地扩大其技术影响力;还有人认为,这场泄露事件背后也有当前大模型领域中开源VS闭源(或通过API进行分发)的两条道路之争……

争论不断,热议纷纷。当前,LLaMA项目已在GitHub收获17.4k星,而基于它所诞生的“羊驼家族”,还在一路狂奔。

编译/综合:南都记者杨博雯

相关文章

猜你喜欢