允中 发自 凹非寺

量子位 | 公众号 QbitAI

进入2023年7月,大语言模型(LLM)的发展进入了新阶段,开源成为一个火热的主题。

7月6日,上海人工智能实验室与商汤科技等联合发布了书生·浦语开源体系(https://github.com/InternLM),不仅开源了书生·浦语的轻量版本(InternLM-7B),还率先开源了从数据、训练到评测的全链条工具体系,并提供完全免费的商用许可;7月14日,智谱科技开放ChatGLM2-6B免费商用;7月19日,Meta开源了性能更强的Llama-2,也提供了更加宽松的商用许可。面对语言模型的新一波开源浪潮,图灵奖得主Yann Lecun在推特上评价:

This is going to change the landscape of the LLM market.

可是,开源模型的表现是否可以当得起业界的热切期待?

我们在拿到Llama-2的系列开源模型后,通过OpenCompass对它进行了全方位的评测(https://opencompass.org.cn)。

Llama-2有多强Llama-2相比Llama-1有不少技术层面的改进,从而带来了模型性能、推理效率以及安全性等方面的有效提升。具体而言,重要的改进有以下几点:

模型架构上使用Group-Query-Attention(GQA)来提高模型推理效率,语境长度从2K增加一倍到4K。预训练语料从1.4T tokens增加到2T tokens。在监督微调(SFT)阶段更加注重数据集质量,使用更少但质量更高的SFT数据相比使用百万量级的公开SFT数据,效果显著提升。引入了三项安全训练技术Supervised Safety Fine-Tuning、Safety RLHF、Safety Context Distillation 提升模型的安全性。相比前代性能大增,仍难媲美ChatGPT那么,Llama-2的整体能力究竟如何呢?

虽然在官方技术报告中已经展示了在20个左右数据集上的测试结果,但评价能力维度仍然有限,对比的模型也还不够全面。

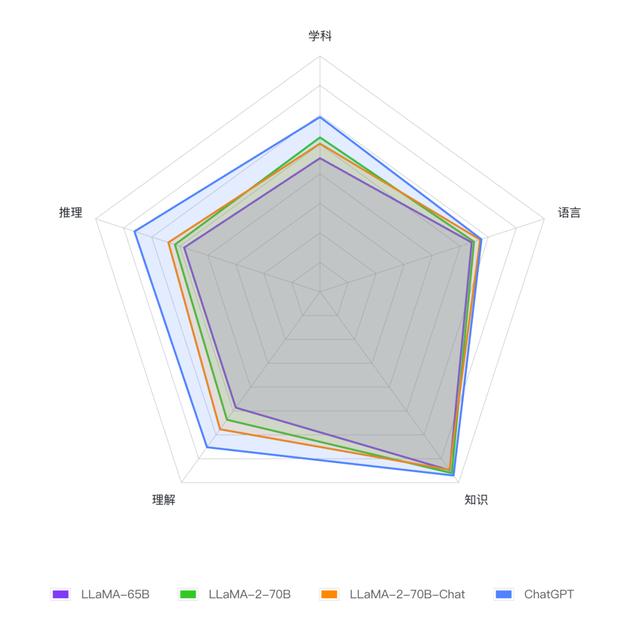

这里我们借助开源评测工具OpenCompass,对Llama-2发布的各个模型在40多个评测集上进行了全方位的评测,从学科、语言、知识、理解、推理五大维度综合衡量大模型的能力。

结果可以总结为以下的雷达图:

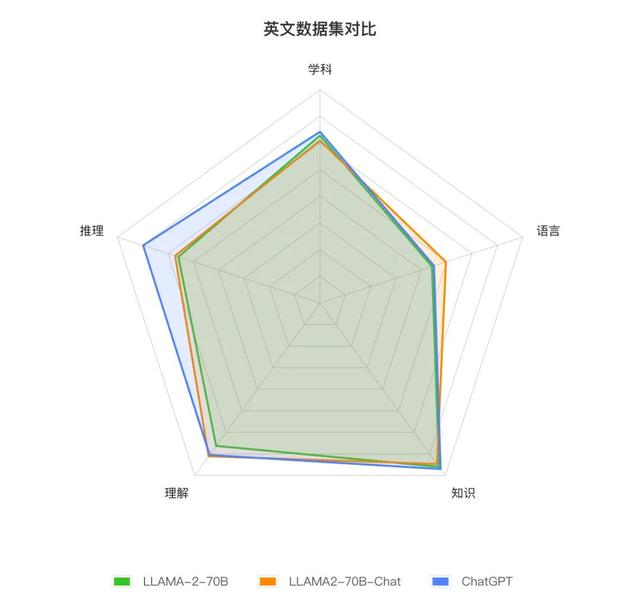

为了对Llama-2的中英文能力有更深入的理解,我们选取了OpenCompass中的中英文数据集进行分别分析。

在重量级模型的对比中,书生·浦语表现优秀,在大部分主流评测集上领先于Llama-2以及ChatGPT。具体而言,在43个评测集中,InternLM-104B在34个评测集中超越ChatGPT,在41个评测集上超越Llama-2-70B。

中文考试大幅领先:

在中文考试评测集CEval和高考评测集GAOKAO-Bench上,InternLM-104B都大幅超过Llama2-70B。

语言能力略有优势:

在中英文的基础语言任务上,包括字词理解,成语习语,翻译等评测集上,InternLM-104B都有优势,其中中文评测集上差距更大。

阅读理解“书生”名副其实:

在中英文的各类阅读理解评测集上,InternLM-104B均表现出明显的优势,从文本段中总结和理解关键信息的能力更胜一筹。

推理能力技高一筹:

在常识推理、数学推理、综合推理的各种数据集上,InternLM-104B都有比较稳定的发挥,相比Llama2-70B有一定优势。

知识问答平分秋色:在BoolQ,CommonSenseQA,TrivialQA,NaturalQuestion等知识问答评测集上,两个模型表现相当,可见知识水平没有明显差异。

代码能力互有胜负:

InternLM-104B和Llama2-70B的代码能力不相上下,HumanEval和 MBPP两个数据集上互有胜负。

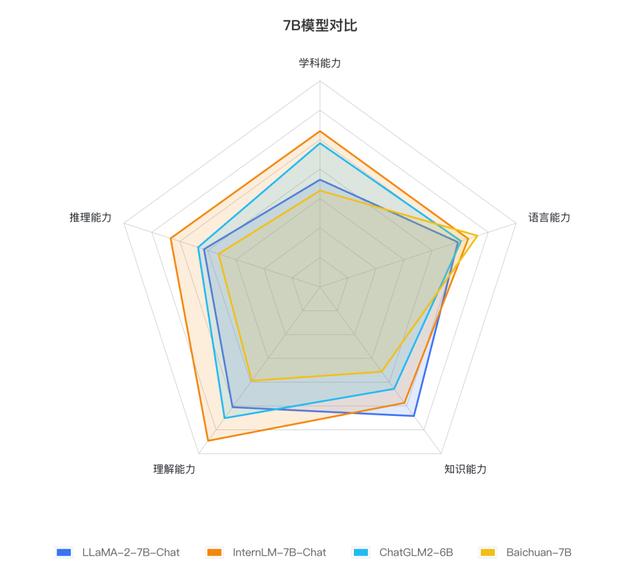

轻量级模型的对比重量级赛道上你追我赶,在7B量级的轻量级赛道上,开源模型的竞争也十分活跃。

在众多国内开源模型之中,百川智能发布的Baichuan-7B、清华大学和智谱AI发布的ChatGLM2-6B、上海人工智能实验室发布的InternLM-7B等优秀模型广受业界关注。

我们把这些国内模型和Llama-2-7B进行了全方位评测对比:

下表列出了这几个7B量级模型在几个有代表性评测集上的表现:

结果显示:Llama-2在知识能力上有明显优势。

但在学科、语言、推理和理解能力上,InternLM和ChatGLM2都已经超越了Llama-2,而且InternLM的领先优势十分明显。

免费商用形成星火之势几个月前Llama的开源引爆了社区,让众多开发者和研究者受益匪浅,衍生出整个羊驼家族,但遗憾的是其协议限制商用,将企业拒之门外。

7月6日,世界人工智能大会上,书生浦语开源体系正式发布,开源了InternLM-7B并提供免费商用许可。

之后,ChatGLM2-6B和Llama2等开源模型相继推进免费商用,顺应了发展潮流和社区呼声。

相信开源社区的星星之火将对产业形成燎原之势,进一步降低大模型落地应用的门槛。

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

相关文章

猜你喜欢