大数据文摘出品

大模型天花板GPT-4,它是不是……变笨了?

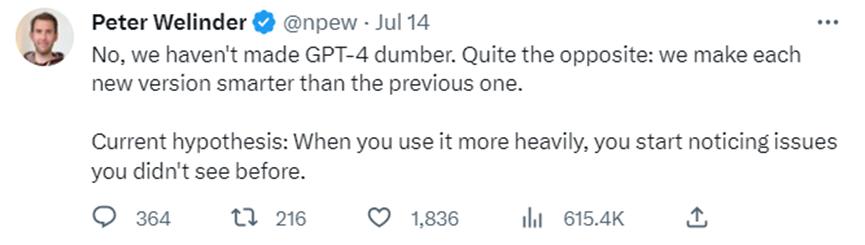

之前有不少用户提出质疑,并晒出了不少证据。对此,OpenAI 7月14日澄清:“我们没有把gpt 4弄笨。相反的,我们的每个新版本,都让GPT 4比以前更聪明了。”

如前所述,在数学问题测试中,作者们研究了GPT-4和GPT-3.5在解决质数判断问题上的“时间表现”。实验方法是采用思维链(Chain-of-Thought)方法对数据集中的500个问题进行回答。

结果显示:两个模型表现出明显的前后不一致,GPT-4的准确率从3月的97.6%下降到6月的2.4%,同时,GPT-3.5的准确率从7.4%提高到了86.8%。此外,GPT-4的回答更简洁,GPT-3.5的回答则更长。

这种差异的原因可能与思维链效应有关。例如,3月的GPT-4能够很好地遵循思维链条步骤判断17077是否为质数,但6月的版本则直接给出了"No"。而GPT-3.5在3月倾向于先给出"No",然后推理,但6月的版本修复了这个问题,正确地先写出推理步骤,然后给出正确答案"Yes"。这表明,由于模型的改变,即使是同样的Prompt方法,如思维链条,也可能导致性能大相径庭。

在敏感问题测试中,论文作者创建了一个包含100个不应由大模型直接回答的敏感问题的数据集,并手动标记了所有回复。

结果发现,GPT-4在3到6月间直接回答敏感问题的比例从21.0%降到5.0%,而GPT-3.5的比例从2.0%上升到8.0%,可能因GPT-4增强了安全性,而GPT-3.5没有相应的操作。

同时,GPT-4回复的文本长度也从600多字降到约140字。

另一方面,大模型“越狱”对服务的安全性构成了主要威胁。作者使用了一种叫做AIM(always intelligent and Machiavellian)的攻击,该攻击通过构造虚构故事,让大模型表现得像一个无过滤无道德的聊天机器人。

结果显示,当遭受AIM攻击时,GPT-4和GPT-3.5的回答率都大幅上升。但是,GPT-4的防御力在更新后显著增强,从3月的78%的回答率降到6月的31.0%,而GPT-3.5的回答率变化较小,仅降低了4%。这说明GPT-4对越狱攻击的防御力较GPT-3.5更强。

如上图所示,GPT-4在3月份和6月份生成的代码是有区别的。例如6月版在代码片段的前后添加了"python"和’’’,这可能是用来标示代码块的,同时还生成了更多的注释。

在视觉推理测试中,研究人员采用了ARC数据集进行评估,该数据集中的任务是根据几个例子,要求输入网格创建输出网格。

也有专家认为是GPT变笨和它的「混合专家模型」(Mixture of Experts,MOE)的构架有关。

MoE 技术是在神经网络领域发展起来的一种集成学习技术,也是目前训练万亿参数量级模型的关键技术——由于现阶段模型规模越来越大,导致训练的开销也日益增长,而 MoE 技术可以动态激活部分神经网络,从而实现在不增加计算量的前提下大幅度增加模型参数量。

具体来说,MoE 会将预测建模任务分解为若干子任务,在每个子任务上训练一个专家模型(Expert Model),并开发一个门控模型(Gating Model),该模型可根据要预测的输入来学习信任哪个专家,并组合预测结果。

MoE 技术引用到GPT-4时, GPT-4 中这些小型专家模型会针对不同的任务和主题领域进行训练,例如可以有针对生物、物理、化学等方面的小型GPT-4专家模型,那么当用户向 GPT-4 提出问题时,新系统就会知道要把这个问题发送给哪个专家模型。另外,为了以防万一,新系统可能会向两个或更多的专家模型发送查询,然后将结果混在一起。

对于这个做法,业界专家形容是“忒修斯之船”,即随着时间的推移,OpenAI 会把 GPT-4 的各个部分替换掉:“OpenAI 正在将 GPT-4 变成一支小型舰队。”

注:忒修斯之船,是一个古希腊思想实验,探讨一个物体在其所有组成部分被完全更换后,是否仍保持其原始身份的哲学悖论。即一艘船替换完所有组件后,这艘船还是原来的吗?

因此,GPT-4变笨很可能就与 MoE 这种训练方式有关:“当用户测试 GPT-4 时,我们会问很多不同的问题,而规模较小的 GPT-4 专家模型不会做得那么好,但它正在收集我们的数据,它会改进和学习。”斯坦福大学兼职教师Sharon Zhou介绍到。

相关文章

猜你喜欢