数据显示,GPT训练数据量从1代到目前的3代一直在高速增长,GPT-3的参数量已经达到1750亿,而算力费也已经是千万级别。

可见,GPT-3靠的是通过规模化现有算法模型,来实现算力的增长。回顾GPT-3 的技术思路,可以发现AI 领域的一个明显趋势是:要训练一个有颠覆性进步的模型,最终比拼的是算力规模。

02、算力,一场富人的游戏?神经网络之父Geoffrey Hinton在GPT-3出现后,曾这样感慨:“生命、宇宙和万物的答案,其实只是4.398万亿个参数而已。”

算力是AI发展始终绕不开的问题。

罗氏、辉瑞、诺华、默沙东等等著名药企,都瞄准AI完成药物筛选,加速新药研发进程;谷歌的AI程序AlphaFold 2,去年成功解决了蛋白质折叠的问题,相当于突破了生物学50年的重大难题……这些科技成果背后离不开计算机的发展,计算机算力已经成为基础科研、前沿研究的重要工具。GPT-3的参数量已经达到千亿级别,规模接近人类神经元的总量,就是最好的例子。

但强大的算力往往靠的是财力的支持。其实GPT-3不仅训练成本高,此前微软还为训练它特地建设了一个5亿美元的超算中心。微软这个超算中心装载了一万张英伟达GPU,训练GPT-3消耗了它355个GPU年的算力。

因此算力带来的经济成本也成为了国内AI研发的壁垒。一方面,国内AI大厂拥有的软硬件虽然多,但是不够开放,闲置的算力资源被散落在各个平台。

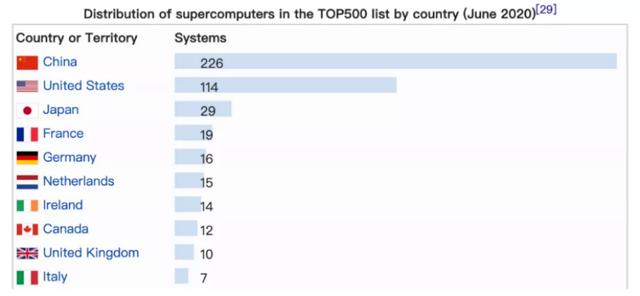

中国拥有全球超算Top500中的226台

另一方面,中国很少有企业能够像微软一般财大气粗组件算力中心。因为即使是比GPT-3规模更小的AI模型,动辄耗费几十乃至上百张AI加速卡,对很多企业来说也是“不能承受之重”。

03、谁能打造国内的AI发电厂?那么在中国,如果打造出一个比GPT-3更强,甚至像安怡一般超出想象力的人工智能呢?

目前看来市面上有两种路径可以走,一种是开发出更加强大的算法,更高效地利用算力,节省费用;另一种是就是在现有算法基础上进行规模化训练,让更多AI模型获得丰富的训练参数,从而达到优质模型的开放。但当下,走通两条路的前提都是拥有强大的算力。据估计,未来人工智能将占据80%以上的计算需求,需要有开放的AI算力中心承载这种需求。

还记得去年国家发改委明确划定“新基建”的概念范围时,指出“人工智能作为信息基础设施板块中的新技术基础设施,因其对传统产业的创新和重塑能力,更被誉为是数字经济时代的‘新电能’”。

因此当AI被誉为数字经济时代的“新电能”时,谁先搭建开放的算力中心,谁将成为国内的AI发电厂。

开源这件事,在过去的手机行业取得了巨大的成功,凭借软件开放、硬件整合的能力,普通消费者短短十年内享受到了智能手机普及的福利。

因此AI产业若能完成算力的软件与硬件的开源,就能让AI行业迅速发展。

因为开源可以高效统筹散落的闲置算力资源,达到提高算力的结果,从而低成本实现整个产业的共赢。

2011年,Facebook牵头发起了OCP开放计算项目,4年时间内OCP就为Facebook节省了20亿美元的成本,数据中心电费降低了20%。

还有英特尔、微软、谷歌都在以开放的姿态融合更多新的AI硬件,把更强大的算力贡献给产业。

反观国内,阿里拥有突出的云计算能力,为超过一半的A股上市公司、80%中国科技创新企业提供服务;商汤做为中国知名的AI算法提供商,已公开的全球专利资产近2000件,覆盖20个国家和地区;浪潮智算中心与5G结合,提供了云端训练、边缘推理的新应用场景……这些前言AI企业都能把算力供给全行业使用,就能推动AI的产业化,以国内庞大市场,也一定能催生更强大AI模型的诞生。

04、未来价值

04、未来价值知名风投机构 A16Z合伙人Frank Chen关于CPT-3的观点是,GPT-3让使用者避开了培训数据以及建立AI业务的部分经济成本,这使得NLP(自然语言处理)成为AI研发最有前途的领域之一。因为有了GPT-3,很多AI初创公司的软件都内置了最新的NLP技术。

这意味着,开放API的GPT-3已经对AI创业公司产生正向的影响。随着算力的开放,AI时代拥有更多低廉的算力资源,更多像GPT-3一样的AI模型就会低成本出现,从而推动AI的产业化。

但新兴的技术往往面临高速发展与低速商业化的困局,因此新旧技术之间的交替也非常考验资本与企业的耐心。但不能偏于一隅的仅仅讨论商业应用价值,因为它代表着未来的竞争力。

几十年前,柯达说,你负责按快门,剩下的交给我们。

在未来,AI 或许也会表明心态,人类什么都不用干,剩下的交给它。

相关文章

猜你喜欢