本文来自微信公众号:新经济风控官(ID:gh_32c83ce4147b),作者:高亚平(德恒上海律师事务所合伙人)、纪倩,原文标题:《AIGC照镜子(一):ChatGPT如何看待自身〈隐私政策〉?》,题图来自:视觉中国

毫无疑问,随着以ChatGPT为首的一大批生成式人工智能产品相继面世,我们正在经历新的一轮“工业革命”。

然而,生成式人工智能的爆发式增长背后,商业秘密泄露、个人信息泄露、网络安全攻击等问题也引发了各国监管机构的“冷思考”。如英国信息专员办公室在3月15日宣布更新了有关人工智能和信息保护的指南,旨在保障英国用户(含弱势群体)的利益;美国也正在就人工智能系统的潜在问责措施征求公众意见。

我国监管部门对此也采取了相应举措,在4月11日由国家互联网信息办公室发布了《生成式人工智能服务管理办法(征求意见稿)》(下称《管理办法》),明确提出了服务提供者所需承担的责任及义务。

在此背景下,ChatGPT作为一个先进的人工智能语言模型,自然也需要对自身的《隐私政策》1进行审视。

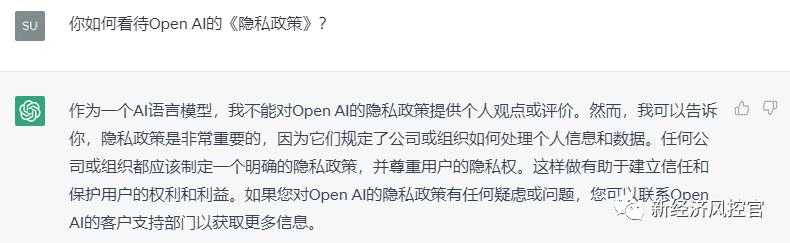

当然,如果直接问它如何看待自身《隐私政策》的法律风险,它会明确告诉你:

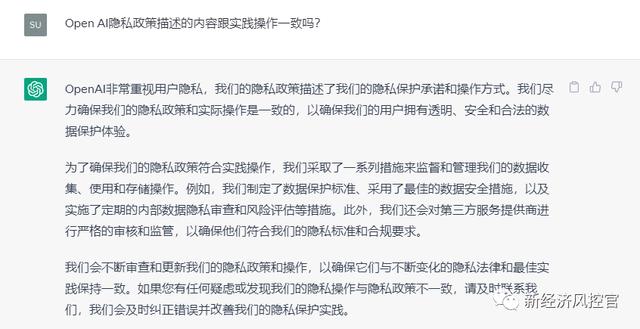

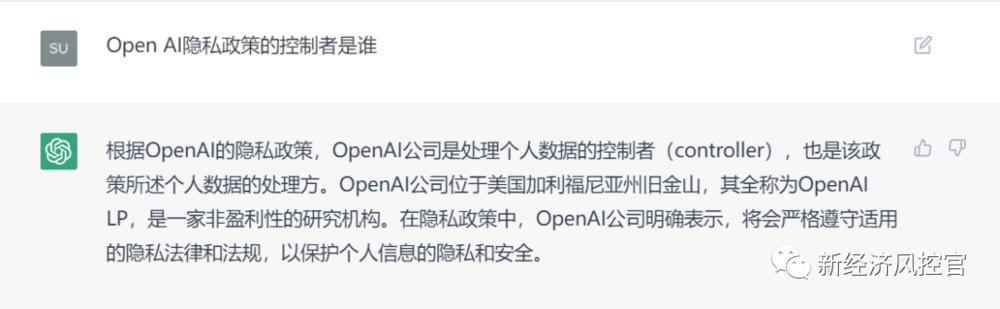

《隐私政策》在开篇及第9部分(“International users”)中明确了自己作为数据控制者的身份及具体的主体信息,与ChatGPT的回答一致。

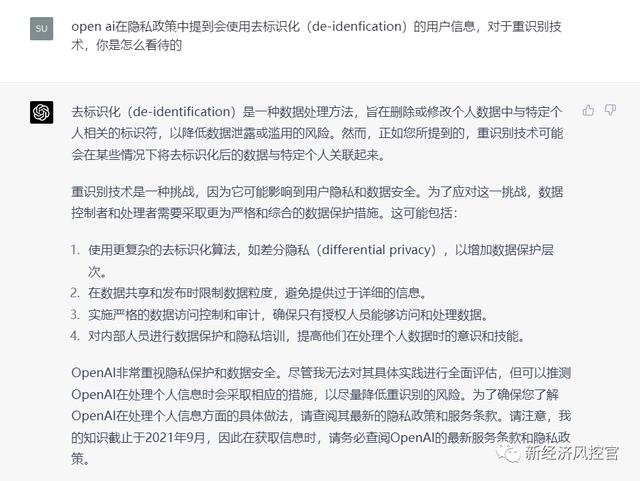

《隐私政策》第2部分(“How we use personal information”)中列出用户个人信息的主要用途,其中特别提到个人信息汇聚融合(Aggregated information)及去标识化(De-identified information)使用,以用于分析服务有效性、提升和增加服务特性、进行研究等目的。

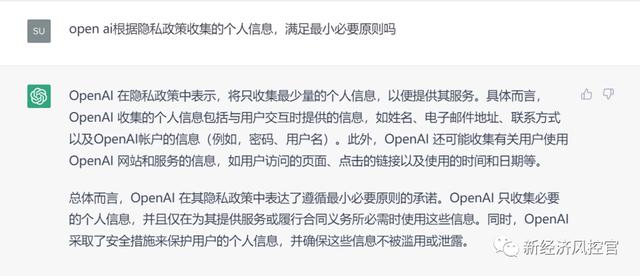

对此,我们询问了ChatGPT收集该等信息是否符合最小必要原则,ChatGPT给出了肯定的答案。

分析:不合规

《隐私政策》显然并没有就“汇聚融合”的合法正当性进行充分表述,尤其是在该等汇总或去标识化的个人信息还将与第三方进行共享的情形下。即使是“匿名”个人信息也面临着“重识别”的风险,更何谈只是“去标识化”的个人信息。

个人信息共享合规吗?

分析:不合规

总体而言,《隐私政策》中有关个人数据权利具体行使路径的表述不够清晰,未说明哪些权利可以通过账户设置行使,哪些权利需要通过邮件方式申请;同时反馈时限也没有予以明确。

儿童个人信息的收集合规吗?

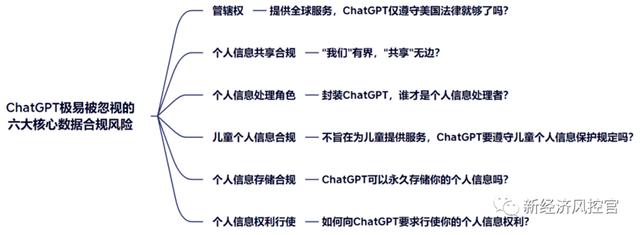

基于对《隐私政策》自身文本的分析,结合ChatGPT的回复,我们凝练为下述六大核心数据合规问题:

对于上述合规问题的具体分析,将于后续系列文章中展开。

引用:[1]Privacy policy (Updated Apirl 7,2023),https://openai.com/policies/privacy-policy, 2023年4月16日访问。

本文来自微信公众号:新经济风控官(ID:gh_32c83ce4147b),作者:高亚平(德恒上海律师事务所合伙人)、纪倩

本内容为作者独立观点,不代表虎嗅立场。未经允许不得转载,授权事宜请联系 hezuo@huxiu.com

正在改变与想要改变世界的人,都在 虎嗅APP

相关文章

猜你喜欢