2020 年 5 月, OpenAI 发布了迄今为止全球规模最大的预训练语言模型 GPT-3。GPT-3 具有 1750 亿参数, 训练所用的数据量达到 45TB, 训练费用超过 1200 万美元。对于所有任务,应用 GPT-3 无需进行任何梯度更新或微调,仅需要与模型文本交互为其指定任务和展示少量演示, 即可使其完成任务。

2020 年 11 月 30 日, Google 旗下 DeepMind 公司的 AlphaFold2 人工智能系统在第 14届国际蛋白质结构预测竞赛(CASP)中取得桂冠, 在评估中的总体中位数得分达到了 92.4分, 其准确性可以与使用冷冻电子显微镜(CryoEM)、 核磁共振或 X 射线晶体学等实验技术解析的蛋白质折叠后的 3D 结构相媲美, 有史以来首次把蛋白质结构预测任务做到了基本接近实用的水平。

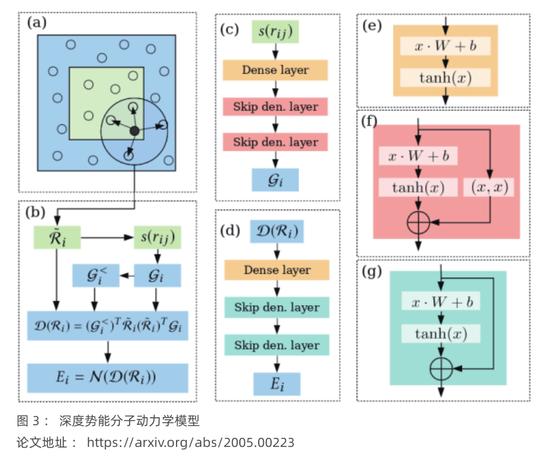

2020 年 11 月 19 日, 在美国亚特兰大举行的国际超级计算大会 SC20 上, 智源学者、 北京应用物理与计算数学研究院王涵所在的“深度势能”团队, 获得了国际高性能计算应用领域最高奖项“戈登·贝尔奖”(ACM Gorden Bell Prize)。“戈登·贝尔奖”设立于1987年,由美国计算机协会(ACM)颁发,被誉为“计算应用领域的诺贝尔奖”。

相关文章

猜你喜欢