智东西

编译 | 吴菲凝

编辑 | 李水青

智东西4月6日消息,根据Meta官方博客,Meta在本周三推出了一个AI模型Segment Anything Model(SAM,分割一切模型),能够根据文本指令等方式实现图像分割,而且万物皆可识别和一键抠图。

Meta AI在推特宣布发布SAM模型

Meta在博客中称,SAM的灵活性在图像分割领域内属首创,SAM以交互式方式标注一个掩码(mask)仅需约14秒。英伟达AI研究科学家Jim Fan称,该模型的发布是计算机视觉领域的“GPT-3时刻”,因为该模型能对从未训练过的图片进行精准分割。在推出SAM的同时,Meta还发布了一个图像注释数据集Segment Anything 1-Billion mask(SA-1B),该数据集包含超11亿个掩码,据称是同类数据集中最大的。

目前,Meta内部已经在使用SAM技术来进行标记照片、审核内容以及向Facebook和Instagram用户推荐内容等,同时更多在VR/AR、智慧农业等领域的颠覆性应用畅想也在官网展示了出来。

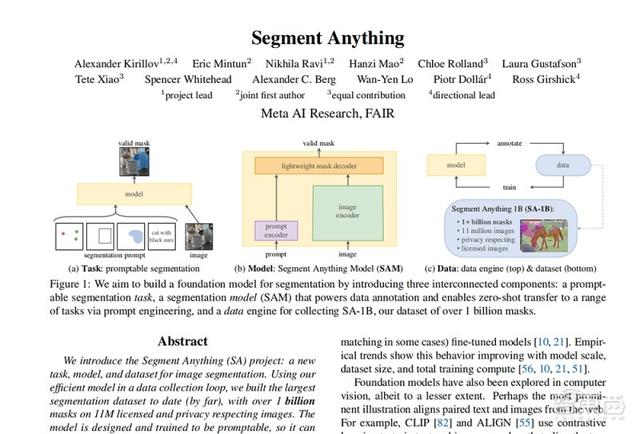

Meta研发团队在官网上发布了关于Segment Anything的论文细节。

SAM自动分割图像中的所有内容;

自动给不明确的提示生成多个valid mask(有效掩码),让用户能精准选中图像;

SAM还能启用文本框输入来检测界定对象,当用户在文本框中输入“cat(猫)”这个单词时,SAM会框定住图像中所有的猫,并在框中精确选取猫的整个图像轮廓。

二、领域内首创:由1000万张图片训练,可提取11亿 掩码

二、领域内首创:由1000万张图片训练,可提取11亿 掩码在自然语言处理和计算机视觉领域,基础模型是其发展的重要基础,基础模型可以使用“prompting(促进)”技术对新数据集和任务执行零样本和少样本学习。Meta从中汲取了灵感,并对SAM模型进行训练。

在Meta发布一篇论文中,研发团队人员详细介绍了SAM的相关细节。

扎克伯格称,将这种生成式AI作为“创意辅助工具”纳入到Meta的应用程序中是今年工作目标的重中之重。

目前,SAM模型和数据集仅在非商用许可下提供下载,用户在将自己的图片上传到原型上时,必须承诺不将其用作研究。

未来,SAM可用于通过AR眼镜识别日常物品,向用户发出提醒和指示。

SAM也将对其他领域产生影响,比如指导农民进行粮食生产或协助生物学家进行研究等。

结语:图像分割再进化,Meta掀起CV革命?图像分割技术并非是新鲜事,但SAM能识别出训练数据集中不存在的物体,或许将会引发新一轮AI视觉应用潮。未来,Meta通过分享他们的研究和数据集,将会使这类组合系统设计在多个领域得到广泛应用。SAM将会是内容创作、图像生成等更为普遍的AI领域的一个强大组件,让图像识别和视觉内容的语义理解之间更好耦合,释放出更强大的AI潜力。

来源:Meta官方、路透社

相关文章

猜你喜欢