预训练阶段是从2018年到2022年,相比之前的最大变化是加入自监督学习,张俊林认为这是NLP领域最杰出的贡献,将可利用数据从标注数据拓展到了非标注数据。该阶段系统可分为预训练和微调两个阶段,将预训练数据量扩大3到5倍,典型技术栈包括Encoder-Decoder、Transformer、Attention等。

随后他介绍了一个研究工作的结论:在高资源语言上,ChatGPT机器翻译效果与商用MT系统效果接近;在低资源语言上,目前ChatGPT机器翻译效果与商用MT系统相比差得比较远。

从这些阶段中数据、算法、人机关系的变化,可以观察到NLP的发展趋势。

数据方面,从少量标注数据、大量标注数据、海量非标注数据 少量标注数据到海量非标注数据,越来越多数据被利用起来,人的介入越来越少,未来会有更多文本数据、更多其它形态的数据被用起来,更远的未来是任何我们能见到的电子数据,都应该让机器自己从中学到知识或能力。

算法方面,表达能力越来越强,规模越来越大,自主学习能力越来越强,从专用向通用,沿着这个趋势往后,未来Transformer预计够用,同时也需要替代Transformer的新型模型,逐步迈向通用人工智能。

人机关系方面,人的角色逐渐从教导者转向监督者,未来可能会从人机协作、机器向人学习,发展成人向机器学习,最后由机器拓展人类。

二、大型语言模型的三大技术路线:Bert、GPT、混合模式张俊林分享道,近5年来,大型语言模型研究的发展有三条技术路线:Bert模式、GPT模式、混合模式。其中国内大多采用混合模式,多数主流大型语言模型走的是GPT技术路线,直到2022年底在GPT-3.5的基础上产生了ChatGPT。

为什么GPT-3问世两年了,还没有受到足够广泛的关注?车万翔认为,这是因为它只解决了知识存储问题,尚未很好解决“知识怎么调用”的问题,而ChatGPT相当于解决了这一部分。两块打通后,就产生了非常好的应用效果。

中国科学院自动化研究所研究员张家俊介绍了ChatGPT的通用能力基座。OpenAI在2020年用45T文本数据,通过自监督训练获得基础大模型GPT-3,实现了流畅性、知识性;2021年在GPT-3基础上利用179G代码数据,通过自监督训练获得逻辑编程模型Codex;2022年利用更多更新文本数据和代码数据的混合学习,得到了更强的基础大模型GPT-3.5,这成为ChatGPT的基础模型,实现了流畅性、知识性和逻辑性。

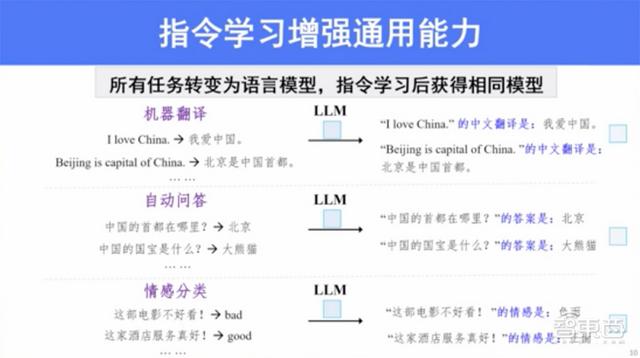

据他分享,大模型的通用能力由基础模型决定,GPT-3用提示学习方法触发通用能力。

参数微调通过任务相关的监督数据修改模型参数,能够最大限度激发预训练大模型完成特定任务的能力,但面临数据稀、灾难遗忘、资源浪费、通用性差等难题。

提示学习通过设计提示信息修改输入模式,能够触发预训练大模型完成特定任务,但是单一的外部提示信号难以最大限度地激发预训练大模型的能力,从而高质量完成具体任务。

将两者结合,通过若干任务相关的经过提示增强的监督数据修改模型参数,有助于激发模型的通用能力。

紫东太初多模态大模型便尝试模型交互实现通用多模态对话。这是一个拥有千亿参数规模的图文音三模态大模型,通过学会API的使用,让较小的语言大模型拥有通用的多模态对话能力。3月24日,张家俊将在「GTIC 2023中国AIGC创新峰会」上发表演讲,分享紫东太初大模型的更多进展。

五、大模型的未来:多模态、具身智能、社会交际

五、大模型的未来:多模态、具身智能、社会交际车万翔认为,ChatGPT可以说是继数据库和搜索引擎后的全新一代知识表示和检索的方法。

早期NLP基于文本,再往后发展要走向多模态、具身认知、社会交际。ChatGPT已经似乎有与人类社会互动的意思,相当于是跳过了中间两步,但车万翔认为,要真正实现通用人工智能,中间这两步是不能跳的,不然就像盲人在学语言。据传GPT-4会是一个多模态大模型,如果解决了多模态这一步,那就只剩下具身了。

多模态大型语言模型的目标是增强更多的现实环境感知能力,包括视觉输入(图片、视频)、听觉输入(音频)、触觉输入(压力)等等。张俊林认为,目前阻碍多模态大模型发展的一个障碍是其很大程度上依赖于人工整理的大数据集,图像处理的自监督技术路线尚未走通,如果走通可能会是又一大技术突破,一些图像理解类任务大概率会被融入大型语言模型,不再单独存在。

多模态大模型是具身智能的基础,相当于大脑,它还需要身体,才能与物理世界的交互。因此下一步就是将大脑与身体(如机器人等)结合的具身智能,利用强化学习,从真实世界获得真实反馈、学习新的知识。

另一个值得探讨的话题是大型语言模型的规模,做大还是做小?

张俊林谈道,一方面,Scaling Law说明了模型规模越大,数据越多,训练越充分,大型语言模型的效果越好;另一方面,训练成本太高了,Chinchilla证明了如果在数据充足的前提下,目前大型语言模型的规模比应有的合理大小更大些,似乎存在参数空间浪费。因此应该是:先把模型做小,充分利用模型参数后,再将模型做大。

除此之外,张俊林认为大型语言模型的复杂推理能力未来将进一步提升。大型语言模型如何与专用工具结合也是非常有前景的方向,但技术尚不成熟,他判断OpenAI应该不会走这条路。

大型语言模型还有很多问题有待克服,包括构建中文评测数据集、优化新知识的获取、优化旧知识的修正、探索私域领域知识的融入、优化更好理解命令的能力、降低训练推理成本等等。

结语:大模型与生成式AI驶入快车道自然语言处理被誉为人工智能皇冠上的明珠,而其最新代表之作ChatGPT凭借卓越的多轮对话和内容生成能力,正掀起新一轮人工智能研究、商用及创业热潮。

ChatGPT仍有很多问题,比如事实检索性和复杂计算性效果差,无法实现一些实时性、动态变化性的任务等。但优化这些问题以及提升大模型能力的研究正在飞速推进。

如果上周微软德国公司CTO兼AI部门主管Andreas Braun透露的信息为真,那么本周OpenAI将发布更强大的GPT-4多模态大模型,打通认知与感知的连接。百度基于文心大模型研发的生成式对话产品“文心一言”也将于本周四3月16日正式发布。微软将在周五举行主题为“与AI一起工作的未来”的在线活动。大模型与生成式AI领域正变得愈发热闹。

相关文章

猜你喜欢