机器智行原创

作者:于雷

AI大模型 DriveGPT 重塑汽车智能化技术路线。

2 月 17 日,毫末智行预告了即将发布自动驾驶生成式大模型 DriveGPT。与近几个月大火的 ChatGPT 一样,DriveGPT 同样都所采用了 Transformer 模型,同时也使用了 RLHF(人类反馈强化技术)算法进行强化训练;与 ChatGPT 使用自然语言文本进行训练不同,DriveGPT 使用的是驾驶场景数据进行模型训练,并通过不断引入真实人驾接管数据,让模型自我优化,逐步训练自己不断给出更高质量的答案。

昨天(4 月 11 日),在第八届 HAOMO AI DAY 上,毫末正式对行业首发了 DriveGPT 自动驾驶生成式大模型,同时也公布了其中文名「雪湖・海若」。

毫末智行CEO顾维灏

同时,毫末还在现场宣布雪湖・海若的首发车型是魏牌新摩卡 DHT-PHEV,后续将落地到魏牌蓝山。这意味着雪湖・海若将在 2023 年智能驾驶产品竞争中,起到关键作用。

「2023 年将是智能驾驶冲刺之年、大考之年。」毫末智行董事长张凯判断,「2023 年智驾产品进入全线爆发期,大模型开启在车端的落地应用,车主的使用频率和满意度成为产品竞争力的重要衡量标准。」

最近广受关注的 ChatGPT 就属于语言类生成式大模型,主要是模拟人类语言行为,根据输入的文字或图片生成回答,与用户交互。而 DriveGPT 雪湖・海若则是用于自动驾驶场景的生成式大模型,所以毫末智行把 ChatGPT 输入的自然语言文本串,换成智能驾驶感知到的过去场景,输出也就变为了包括自车决策规控、障碍物预测以及决策逻辑链等条件在内的未来场景。

在这之中,一个重点就是如何将智能驾驶场景,变为和自然语言一样的 Token,毫末智行给出的答案是 Drive Language。其基于毫末智行的 CSS 场景库理论,利用 BEV 网格来做整个空间的离散化,将每一个网格定义为一个固定大小的词表,这样输入代表已发生场景的 Token 序列,就可以根据历史生成未来的 Token 序列。

目前,毫末智行 Token 化后的词表空间,已经达到了 50 万量级。最终,一连串的 Token 拼起来就是一个完整的驾驶场景时间序列,包括了未来某个时刻的完整交通环境状态和自车状态。

顾维灏介绍:「DriveGPT 可以按概率生成很多个这样的场景序列,每一个场景序列都是未来有可能发生的一种实际情况,这是它的第一个特性。它的第二个特性是在所有场景序列都产生的情况下,能把场景中我们最关注的自车行为轨迹给量化出来,也就是生成场景的同时,便会产生自车未来的轨迹信息。」

顾维灏表示:「我们通过一个初始化模型(Pre-Train Model)去生成并收集一些候选数据。然后,通过一个反馈模型给这些数据打分排序,再用强化学习的思路,把反馈模型认为好的结果排上来,差的结果排下去。最后,把参数更新到一个备份模型(Active Model)中,通过强化学习的方式,DriveGPT 生成的效果就会有一个明显地提升。」

在强化学习阶段,毫末智行还在过去搜集到的所有接管数据里人工挑选出大概 5 万段能够覆盖到各种比较复杂场景、真实驾驶偏好的数据,回灌训练反馈模型。有了这个之后,雪湖・海若就能在预训练模型上加入 Prompt 提示语,模型就可以根据其所代表的特征,将含有决策逻辑链(Chain of Thought,CoT)的未来序列重新排序,给出更符合期望的驾驶策略。

「DriveGPT 还能输出决策逻辑链,这里面利用了 Prompt 提示语技术,输入端需要给到模型一个提示,告诉它『要去哪、慢一点还是快一点、并且让它一步步推理』。经过这种提示后,它就会朝着我们期望的方向去生成结果,并且每个结果都带有决策逻辑链。每个结果也会有未来出现的可能性。这样我们就可以选择未来出现可能性最大,最有逻辑的链条驾驶策略。」顾维灏介绍。

毫末 CSS 自动驾驶场景库是 CoT 的重要输入,拥有超过几十万个细颗粒度场景,将 Prompt 提示语和完整决策过程的样本交给模型去学习,学到推理关系,从而将完整驾驶策略拆分为自动驾驶场景的动态识别过程,完成可理解、可解释的推理逻辑链生成。

AI 大模型基础设施

MANA OASIS 雪湖・绿洲再升级

DriveGPT 雪湖・海若的训练和落地,也离不开算力的支持。毫末智行目前已对其智算中心 MANA OASIS 雪湖・绿洲进行了三大升级,使训练过程中的稳定性、效率和速度得到有效提升。

其次是基于量产自动驾驶规模优势,构建了以真实数据回传为核心的增量式学习推广到大模型训练。结合增量学习数据以动态数据流的形式,持续不断将量产回传和筛选的存量数据,传入感知和认知 Pre-train 大模型。系统定时采样评测模型学习状态,出现异常快速回滚,持续提取最佳模型版本。

顾维灏介绍:「由于每天回传的数据不同的时段数据量差异巨大,这就要求我们训练平台具备弹性调度能力,自适应数据规模大小。我们将增量学习技术推广到了大模型训,构建了一个大模型持续学习系统,研发了任务级弹性伸缩调度器,分钟级调度资源,集群计算资源利用率达到 95%。」

「我们将鱼眼相机也引入到视觉 BEV 的感知框架当中,鱼眼图像通过 2D backbone 提取出视觉特征,经过空间转换映射至 BEV 空间,并在该空间下对于障碍物的轮廓边界进行识别和测量。」顾维灏介绍。

目前,毫末智行已经能做到在 15m 范围内达到 30cm 的测量精度,2m 内精度高于 10cm 的视觉精度效果。与主流的 USS 超声波雷达方案相比,其探测距离极限明显更高,近距离探测精度也不相上下,有能力在泊车场景取代 USS,进一步降低智能驾驶硬件成本。

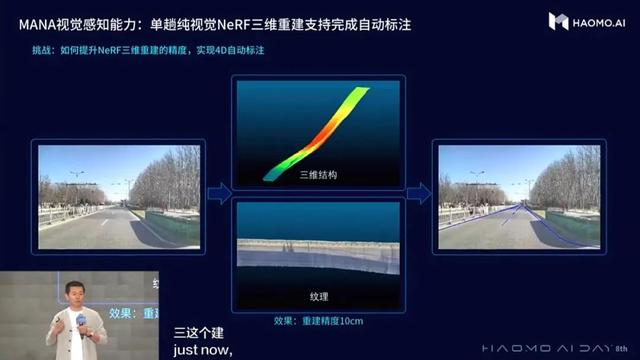

通过视觉自监督大模型技术,做到不依赖激光雷达,将收集的大量量产回传视频转化为可用于 BEV 模型训练、带 3D 标注的真值数据后,毫末智行还在纯视觉 NeRF 三维重建方面取得更多进展。

这些前沿深奥的 AI 技术如何让大众能够体验到呢?

毫末张凯表示,毫末将加速推送城市 NOH 的快速落地,最新功能将在摩卡 DHT-PHEV 上开放,明年预计在国内 100 个城市完成落地。

猜你喜欢