中新网2月19日电 题:ChatGPT热潮下的冷思考:人工智能将如何影响人类的未来?

中新财经记者 宋宇晟

“在接下来的五年中,会思考的计算机程序将阅读法律文件并提供医疗建议。在接下来的十年中,它们将从事流水线工作,甚至可能成为同伴。在此之后的几十年中,它们将做几乎所有事情,包括做出新的科学发现,从而扩展我们的‘一切’概念。”

2021年3月16日,OpenAI公司CEO山姆·阿尔特曼(Sam Altma)在网上发表了一篇名为《万物摩尔定律》的文章,并在文中以预言式的口吻这样描绘了人类与人工智能共处的未来世界。

在阿尔特曼看来,人工智能革命即将到来,其结果必将深刻影响人类的未来。不到两年之后,有关ChatGPT的讨论席卷全球。这似乎意味着现实正逼近他所预测的未来。

那么,人工智能的发展将如何塑造或影响人类的未来?我们还是先从最近备受关注的ChatGPT说起。

资料图

ChatGPT是怎么火起来的?

2022年11月30日发布的聊天机器人模型ChatGPT,正显示其巨大的影响。根据Similarweb的数据,今年1月,平均每天约有1300万独立访客使用 ChatGPT,是去年12月份的两倍多,累计用户超1亿,创下了互联网最快破亿应用的纪录。

如果只把它看作是一个“能与人类对话”的机器人,“技术进步”的迹象并不明显。毕竟Siri、小爱、小度……这些人们如今常用的工具,都可以提供“对话”服务;甚至在2020年,小冰公司还推出过“虚拟男友”聊天产品。这些产品背后的人工智能都可以在不同程度上完成与人类的“对话”。

ChatGPT的“魅力”更多还要从技术上看。其中,“大模型”是关键词。

小冰公司CEO李笛将ChatGPT定义为“大模型”的一个产物、一次产品化的尝试。

何为“大模型”?智源研究院原副院长刘江告诉记者,以AlphaGo为例,这样的人工智能就属于“小模型”。“它只能用来下围棋,象棋、五子棋都不会下。其中可能有些底层技术类似,但如果要让AlphaGo下象棋或五子棋,还需要技术人员重写代码、重新训练。”

“但大模型不同,它是通用的。”刘江举例,ChatGPT的应用场景很广泛,既可以写邮件、写文案,还可以写代码、写诗,甚至写论文。

腾讯研究院发布的《2022十大数字科技前沿应用趋势》中就明确指出,小模型不仅需要大量的手工调参,还需要给机器喂养海量的标注数据,这拉低了人工智能的研发效率,且成本较高。大模型通常是在无标注的大数据集上,采用自监督学习的方法进行训练。

ChatGPT是OpenAI对其2020年发布的GPT-3模型微调后开发出的对话机器人。报道显示,该模型使用来自互联网的文本数据库进行训练,包括从书籍、网络文本、维基百科、文章和互联网其他文本中获得的高达570GB的数据。ChatGPT背后的模型GPT-3.5则更为强大。

中金公司一份研报认为,此类新技术的应用“带来弱人工智能向通用智能的阶跃”。

而在业内人士看来,技术上从小模型到大模型的变化,无异于人工智能的“进化”。

《万物摩尔定律》截图

事实上,在人工智能的加持下,某些领域的演进速度已经大大加快。有报道称,据OpenAI统计,从2012年到2020年,人工智能模型训练消耗的算力增长了30万倍,平均每3.4个月翻一番,超过了摩尔定律的每18个月翻番的增速。

回顾OpenAI GPT模型的进化之路,具有十分明显的规模效应。数据显示,2018年初代GPT参数量为1.17亿,2019年二代参数量达15亿,2020年GPT 3.0参数规模直接飞跃至1750亿。

百度CEO李彦宏就曾公开指出,无论是技术层面还是商业应用层面,人工智能都有了方向性的改变。

微软CEO纳德拉在接受访谈时也曾表示,GPT的发展不是线性的,而是指数级变化的,所以相比较GPT-3,当前的GPT-3.5已经展现出更强的能力。业界普遍预测,GPT-4将在今年推出,并具备更强大的通用能力。

毫无疑问,成指数级的增长让人工智能得以高速“进化”。

刘江告诉记者,这样的“进化”并非只是量变,也不只是每次迭代相加的结果。“有研究人员总结,相比于小模型,人工智能大模型已经出现了一百多种‘突变能力’,即大模型具备、小模型不具备的能力。”

他觉得,这在某种程度上很像生物进化的过程。“就好像大脑在不断量变后来到一个临界点,然后生物就产生了高等智能那样。”

资料图。

巨大突破的曙光隐现?

1950年,计算机科学家艾伦·图灵提出了一个被称为“模仿游戏”的思想实验。面试官通过打字机与两个对象交谈,知道一个是人,另一个是机器。图灵建议,如果一台机器能够始终让面试官相信它是人类,我们就可以说它有能力思考。这就是著名的“图灵测试”。

迄今为止,还没有人工智能模型能真正通过图灵测试,包括ChatGPT。甚至,ChatGPT暴露出待解决、待完善的问题还有很多。

李笛就明确指出,ChatGPT至少存在内容准确问题、运行成本问题、即时性问题。“这些都是根源问题,很难在ChatGPT上得到解决,可能要等新的产品和应用出来。”

以内容准确问题为例,李笛认为,作为知识系统,最基本的要求是准确,但ChatGPT的技术结构决定了它提供的知识很难作到准确。

事实上,该问题已经给人工智能公司造成了真金白银的损失。

“我可以告诉我9岁的孩子关于詹姆斯•韦伯太空望远镜(James Webb Space Telescope,简称JWST)的哪些新发现?” 谷歌推出的类ChatGPT功能Bard回答中包括“JWST拍摄到了太阳系外行星的第一张照片”。

但真实的情况是,第一张系外行星照片是由欧洲南方天文台的Very Large Telescope (VLT)在2004年拍摄的。当天谷歌股价大跌约9%,市值蒸发约1000亿美元。

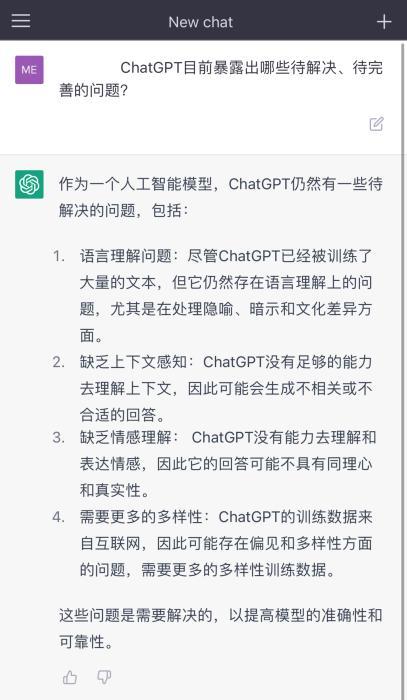

ChatGPT也存在类似的问题。当记者向ChatGPT询问“ChatGPT目前暴露出哪些待解决、待完善的问题”时,它给出的回答与ChatGPT网站上人类列出的其局限性有所出入。

资料图:北京,在服贸会首钢园展区,电信、计算机和信息服务展厅里的舞蹈机器人。中新网记者 李骏 摄

ChatGPT的出现,或许会是技术史上一个新的节点。

人们已经开始谈论人工智能将会如何颠覆他们的工作和生活。而人类此刻与ChatGPT的各种聊天记录,将全部变成下一代模型的训练数据。

在刘江看来,面对即将到来的变革,人类应该拥抱变化、拥抱未来。“人类是在不断变化的,不能固守陈规。当然我们也应该积极思考不允许人工智能突破的底线在哪。”

他不否认人们因此产生对未来工作可能发生变动的担忧。“也许未来每个人身边都会有机器人,就像老板身边的秘书。”

重要的是,我们应如何与人工智能共处。换言之,要解决的问题是,人类的价值是什么?

目前,已有人工智能领域专家提出,要警惕人工智能弱化人类思维。

李笛认为,人类创作者恰恰应当把人工智能视为解放自己创意的新手段或工具,让自己得以进一步回归内容创作的本质,即“创意”上去。

刘江则给出了另外一种假设:伴随着人工智能技术的发展,当生产力极大突破后,或许人类就不必须工作了。也许到那天,人类真的可以实现按需劳动了。(完)

搜索

复制

相关文章

猜你喜欢