导读:介绍 ChatGPT (Open ai),它是基于 GPT-3.5、4.0架构的大型语言模型,由 OpenAI 开发。一起先了解 ChatGPT 的基本原理,部署环境要求,部署方式,集成 ChatGPT API,本地docker 部署 chatgpt。

1 一起先了解 ChatGPT 的基本原理

1 一起先了解 ChatGPT 的基本原理ChatGPT(Chatbot)是基于 GPT(Generative Pre-trained Transformer)-3.5架构的大型语言模型。

GPT 是一种基于深度学习的模型,能够生成连贯、有逻辑的文本。

它经过在大量的文本数据上进行预训练,学习了语言的统计模式和上下文信息,并能够根据输入生成合理的响应。

ChatGPT 的基本原理如下:

Transformer 架构:ChatGPT 使用了 Transformer 架构,这是一种基于自注意力机制(self-attention)的神经网络模型。Transformer 的主要优势是能够捕捉长距离的依赖关系,而无需使用传统的递归循环神经网络(RNN)结构。预训练:在部署之前,ChatGPT 需要经过大规模的预训练。这个过程使用了大量的公开文本数据集,如维基百科、互联网论坛和新闻文章等。通过阅读这些文本数据,模型学习了词汇、句法结构和语义关系等。自回归生成:ChatGPT 是一个自回归模型,意味着它在生成响应时是逐词逐句地进行的。给定一个输入文本,模型会预测下一个最可能的词或字符,并将其作为输出。生成的输出可以进一步用作下一个时间步的输入,以生成连贯的对话。上下文理解:ChatGPT 在生成响应时考虑上下文信息。它会根据前面的对话历史来理解用户的意图,并生成与之相关的响应。通过自注意力机制,模型能够将注意力集中在输入序列中不同位置的相关部分,从而更好地理解语境。Fine-tuning:预训练后,ChatGPT 还需要进行微调(fine-tuning),以适应特定任务或应用。在微调阶段,模型会在特定的数据集上进行训练,例如聊天对话数据。这样可以使模型更好地理解特定领域的语言和上下文,提高生成响应的质量和相关性。总的来说,ChatGPT 利用 Transformer 架构、预训练和微调等技术,能够理解和生成连贯的自然语言对话。

它的基本原理是通过学习大量文本数据的统计模式和上下文信息,以生成合理的响应,并在特定任务上进行微调以提高性能。

2 部署环境要求 2.1.1 计算资源

2.1.1 计算资源ChatGPT 是一个大型的语言模型,需要足够的计算资源来运行和处理复杂的模型推理。较大规模的模型需要更多的内存和计算能力。

您可能需要考虑使用具备足够内存和处理能力的服务器、虚拟机实例或云计算资源。

2.1.2 存储空间预训练的 ChatGPT 模型文件较大,需要足够的存储空间来保存模型参数。

确保您有足够的磁盘空间来存储模型文件,以及处理日志和其他相关数据。

2.2 网络要求

要通过 API 集成 ChatGPT 到应用程序或网站中,以下是一般的指导步骤:

4.1 注册 OpenAI API:访问 OpenAI 的官方网站并注册一个账号。登录后,转到 OpenAI API 部分,并按照流程完成注册和订阅 API 服务的步骤。获取访问密钥(API 密钥),该密钥将用于身份验证和访问控制。

4.2 选择合适的 SDK 或库:OpenAI 提供了多种官方 SDK 和库,可以简化与 ChatGPT API 的交互。根据您使用的编程语言,选择合适的 SDK 或库进行集成。目前 OpenAI 提供 Python、JavaScript 和其他一些流行语言的 SDK 和库。

4.3 安装 SDK 或库:使用所选的编程语言和包管理工具,安装相应的 SDK 或库。例如,对于 Python,可以使用 pip 包管理工具安装 OpenAI 的 Python SDK。

4.4 编写代码:导入所需的库和模块,包括 OpenAI 的 SDK 或库。创建一个 API 客户端对象,并使用您在步骤 1 中获得的访问密钥进行身份验证。根据您的应用场景和需求,编写代码来发送请求和处理响应。通常,您需要构建一个包含用户输入的请求对象,然后通过 API 客户端发送请求。解析 API 响应,提取所需的数据,如 ChatGPT 生成的响应文本。

4.5 测试和调试:在开发过程中,进行测试和调试以确保集成正常工作。测试包括向 ChatGPT 发送不同类型的请求,检查响应是否符合预期。如果遇到问题或错误,检查文档、日志和错误信息,进行适当的排查和修复。

这些是一般的步骤和指导,具体实现可能因所选的 SDK 或库而有所不同。建议仔细阅读 OpenAI 的官方文档和 SDK 文档,以了解详细的使用说明和示例代码。这些文档通常包含了具体的代码示例,展示了如何构建请求、发送请求和处理响应。

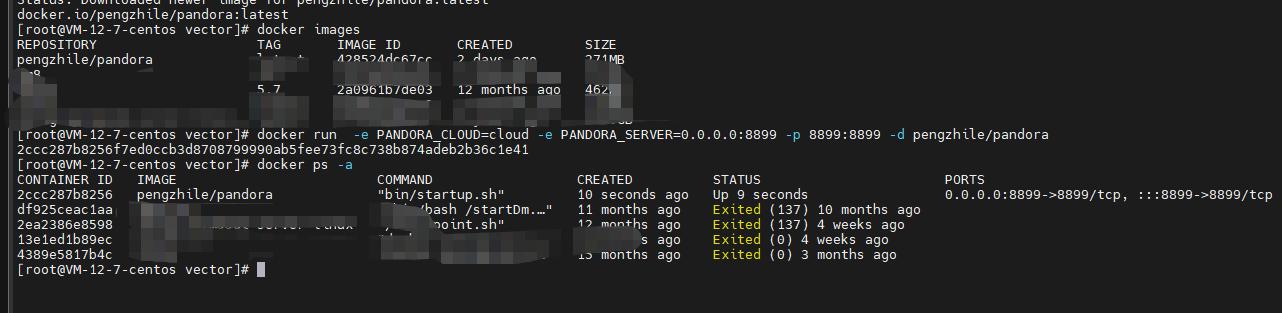

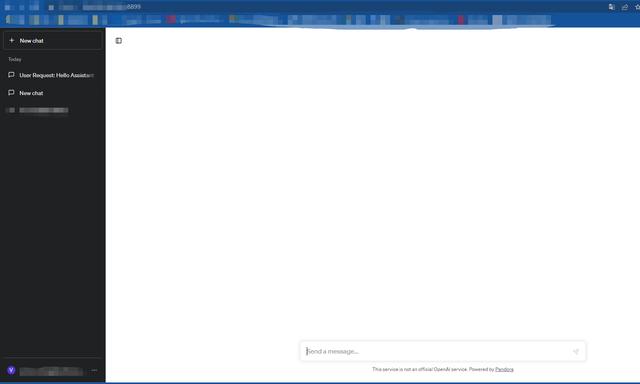

5 本地Docker 部署 chatgpt 一键部署:docker run -e PANDORA_CLOUD=cloud -e PANDORA_SERVER=0.0.0.0:8899 -p 8899:8899 -d pengzhile/pandora

一键部署:docker run -e PANDORA_CLOUD=cloud -e PANDORA_SERVER=0.0.0.0:8899 -p 8899:8899 -d pengzhile/pandora

相关文章

猜你喜欢