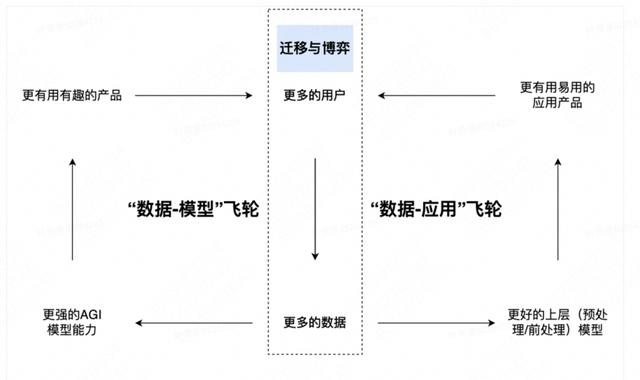

(3)两个数据飞轮之间的迁移与博弈

一个关键并且有趣的事实:上述这两个目标及其衍生的业务飞轮事实上存在一些微妙的结构性矛盾,而这正是一些让人困惑的现象和行为背后的底层原因。OpenAI 自身产品与其上层生态应用产品会在两个数据飞轮间迁移和博弈。

迁移一:OpenAI 自身产品的产品目标,可能会由收集数据反哺大模型,迁移至构建生态普惠大众

典型案例如 GPT 系列模型的 API 产品。GPT-1 与 GPT-2 是 OpenAI 在 LLM 模型上的初期产物,这个阶段的 OpenAI 需要更多的高质量文本数据,因此只向有限高质量用户开放 API,并且以免费和极低的浮动价格提供给用户。到了 GPT-3 发布时,OpenAI 在 LLM 能力上逐渐拉满,通用的文本数据对模型本身的能力提升 ROI 降低,因此 OpenAI 此时对产品进行标准定价并开放给更多用户。到今日,该系列产品已为不需要 waitlist 的标准产品。迁移二:OpenAI 基础模型的能力提升,会导致部分层生态应用产品的用户向 OpenAI 自身产品迁移典型案例如 Jasper 与 ChatGPT。由于 GPT 系列模型的 Alignment 问题,和 API 本身对 C 端用户的易用性问题,在 ChatGPT 发布前普通用户难以使用 LLM 的语言理解与生成能力。因此 Jasper 基于对 GPT 模型能力的理解和使用经验,打造了优于市面所有竞品的营销内容生成平台,并用一年多的时间迅速涨至 9000万 美金的 ARR。然而 ChatGPT 的面市将 Jasper 的优势迅速拉低,模型能力之上过薄的产品令市场质疑其业务的护城河。虽然目前公司的营收仍在高速增长,但是 Jasper 也不得不从营销内容生成平台向营销链路 SaaS 转型,以获取更安全的生态位。这类迁移不是 OpenAI 主观设计的,却是基础模型能力提升必然会发生的。博弈一:有助于提升 AGI 通用能力的场景与用户行为数据的争夺典型案例如 ChatGPT Plugin与 Langchain。Langchain 是一个基于 GPT 生态的工具层开源项目,为开发者用户提供了将私有数据和实时搜索结果与 LLM 能力结合构建应用的方案,是 GPT 生态的重要组件。Langchain 是当前生态最活跃的玩家之一,公司于 2023 年 3 月获得 Benchmark Capital 1000 万美金的首轮投资。然而就在 Langchain 宣布融资消息一周后,OpenAI 推出 ChatGPT Plugins 插件集。Plugins 能够:(1)调用互联网数据解决实效性问题; (2)接入第三方私有数据; (3)操作外部应用。 丰富有用的能力组件直接挤压了 Langchain 的生存空间。然而与市场上认为“Plugins 是 OpenAI 出于商业化目的为构建 LLM 时代的应用商店而推出的”主流观点不同。我们认为 OpenAI 推出 Plugins 的本质原因是为了获取“用户为了解决特定任务时会如何使用应用程序和 API 的行为数据”。

值得注意的是,“正确理解用户意图,准确选择并使用合适的工具可靠地完成任务”这个场景目前竞争激烈。除了 OpenAI 外,Adept AI、Inflection AI 以及 Meta 的 Toolformer 模型都在竞争此领域的生态位。进一步讨论,如果 LLM 未来真的成为新一代的人机交互界面,准确性和可靠性是必要条件。

博弈二:深度垂直场景的数据与用户争夺

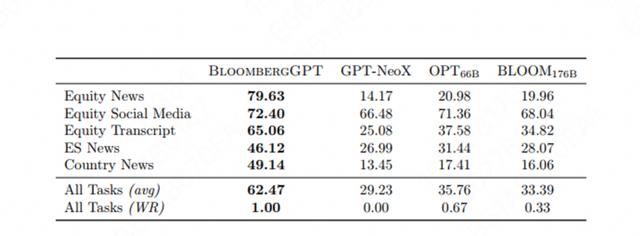

典型案例如 BloomBergGPT。2023 年 3 月 30 日,BloomBerg 发布自研垂直领域 GPT 模型 BloombergGPT,模型参数 50B,训练 Token 700B,其中私有金融数据和公开数据各一半。在私有金融任务上的表现远高于当前的 GPT 模型。

换言之,如果垂直领域的任务复杂度足够深、数据足够独特且数据量足够大,不拥抱通用 LLM 生态而自研垂直领域大模型,可能是一个至少短期内合理的博弈。

整体而言,这两个数据飞轮之间的产品迁移和博弈将会持续存在。

3.1.3 GTM(Go-To-Market)与商业化

整体而言,我们认为 OpenAI 的 GTM 和商业化策略是普惠大众与保持自身独立性间的 trade-off,且公司会在权衡中持续摇摆。

(1)从 OpenAI 到 OpenAI LP:非盈利向有限盈利的转型

OpenAI 在成立之初只有探索普惠 AGI 的愿景,并没有想清楚技术实现路径,大大低估了需要的资金投入。在 OpenAI 以非盈利组织运营的 2 年期间,总融资金额估算只有 1000~3000 万美元左右。2018 年~2019 年是 OpenAI 资金最为困难的阶段。在 2017 年确认 GPT 架构的 LLM 技术路径后,GPT-1 与 GPT-2 的训练烧尽了几乎所有资金。他们不仅无法继续承担下一代模型训练的天价费用,也无法招聘行业优秀人才(实际上已经有研究人才被谷歌挖走)。

在此背景下,非盈利的 OpenAI 于 2019 年 3 月改制为有限盈利的 OpenAI LP。股权改制后,OpenAI 先后接受微软约 130 亿美金投资。此后,OpenAI 不仅可以开出高薪吸引行业顶级人才,承担高昂的 AI 训练费用,打造超级 AI 基础设施,还加快了算法探索和产品研发的速度。

然而对于科技巨头的高度依赖,导致 OpenAI 内部和外部都出现了对其普惠愿景和丧失独立性的质疑,甚至导致了部分核心员工的流失。

我们认为,AGI 是个资金密集型行业,OpenAI 必须要找到可持续探索 AGI 的运营模式。获得外部资金支持和自身产品商业化是当前的两条可选路径。自身产品商业化对于 OpenAI 来说是一个更可控且可以保持自身独立性的模式。因此我们判断,OpenAI 会进一步开展商业化进程,但不会以收入或利润最大化为目标。OpenAI 最根本的目标还是探索 AGI 智能的极限。

有限盈利的商业化策略,会使 OpenAI GTM 和商业化决策不同于传统的科技巨头,进而影响行业生态。

(2)微软与 OpenAI 的合作蜜月期

自 2019 年微软首次投资 OpenAI 以来,双方展开了教科书级别的战略合作。

OpenAI 得到了什么:

资金:2019 年和 2021 年两轮投资总计约 30 亿美元,2023 年 1 月据悉追加了 100 亿美元投资;

工程 Infra 的助力:Azure 对 OpenAI 模型的训练和推理投入了专门的团队支持。更重要的是 2021-2022 年,Azure 和 Greg 带领的 Infra 团队重构了 OpenAI 的整个基础设施,得到了稳定性和可拓展性都极高的模型训练 Infra(可预测的 Scale 对 OpenAI 很重要);

多元优质的特殊数据:GitHub 和 Bing 等特殊的文本数据;

C 端心智占领和丰富的通用应用场景:GitHub(7300 万开发者用户)、Office 套件(1.45 亿的日活)、Xbox(Xbox Live 9000 万月活)分别为 OpenAI 试水 LLM 应用提供了开发者、通用生产力和营销工具、游戏等优质的通用应用场景,与 LLM 形成独有的数据飞轮;

B 端的客户资源和垂直场景:Azure 拥有 95% 的财富 500 强企业,有超过 25 万家公司使用 Microsoft Dynamics 365 和 Microsoft Power Platform;

微软得到了什么:

首先要注意的是,Microsoft 是营收最多元化的科技巨头,第一大业务 Azure 营收占比31%,第二大业务 Office 营收占比 24%。而 Google、Amazon、Meta、Apple 等硅谷大厂的单一主营业务营收占比均超过 50%。

Azure(进攻):作为 OpenAI 的云服务供应商,Azure 是 OpenAI产品 在公有云场景的独家使用平台。如果我们认为未来人类数字活动的 AI 含量将大幅提升,且 OpenAI 的产品会占据大部分份额。那么 Azure 很有可能会获得大部分云计算增量推理市场。同时,Azure 与 OpenAI 共同研发的大规模训练基础设施若开放,则还能获得大部分云计算训练市场。长期来看,这对 AWS 会造成不小的挑战和冲击。

办公套件(防守):Office 套件中所有单品都在受到新型玩家的挑战(Notion、Airtable 等),OpenAI Copilot 与 Office 套件的结合既升级了单品,也放大了 Office 各单品间联动的优势。

Bing Search(防守):很多投资者认为 Bing Search 会颠覆Google。我们在这里有不同的观点。Bing 与 ChatGPT 补丁式的合作其实不改变搜索体验本质,但却是会抢走部分 Google 的搜索流量。真正有可能颠覆 Google 搜索是类似 Perplexity 的 LLM 原生的全新搜索产品。在搜索中增加 LLM 其实反过来会增加单 query 的成本(根据各类推算,不优化的话,当前可能2~3倍于传统搜索),进而降低传统搜索业务的利润空间。而 Google 对于搜索业务的依赖远高于 Microsoft,战略上也就更难受。但不管对于 Bing 还是 Google Search,原本极高的搜索广告营收都阻碍了它们真正在 LLM 语境下像 Perplexity 一样构建全新的信息和知识获取引擎。

现阶段是 OpenAI 和微软合作的蜜月期。不过值得注意的是,模型厂商和云服务厂商在产业链上的价值分配在未来仍然会产生博弈,微软与 OpenAI 的蜜月期能持续多久未可知。

(3)ChatGPT 意外收获的 C 端市场,从基础模型层向应用层的扩展

ChatGPT 让 OpenAI 意外收获了 C 端市场,近 4 个月的时间 ChatGPT 官网总访问量超过 10 亿,独立访客数超过 1 亿。从生态繁荣的角度,基础层涉足应用层在任何产业链中都是大忌,这会极大打击生态位上层玩家对基础层的信任,但是 OpenAI 在此问题上展现出了极大的“无所顾忌”,而这种行为从 AGI 愿景以及更好的数据 Scale 角度可以得到解释:

更低成本的数据获取:通过对 C 端的流量与心智占领,如今 ChatGPT 与 OpenAI 已成为了当前 LLM 的代名词和行业标准。作为一项全新的技术和产品,心智占领可以让 OpenAI 持续以更低的 GTM 成本获得用户数据。

更丰富场景有效数据的获取:比如 Plugin,我们推测,通用的对话数据对于 GPT-4 的边际价值已经不大,但是 Plugin 所收集的通过使用工具完成用户任务的数据非常有价值。这个可能是未来成为真正的新一代人机交互界面的关键(前文提到这个领域竞争激烈)。

通过更多长尾对话和应用场景来优化模型能力:一方面可以加快 Alignment 和安全性的研究,一方面也可以挖掘更多潜力场景。

最大限度保持普惠 AGI 的初心:通过商业化得到巨大的造血潜力,有机会让 OpenAI 未来减少对巨头的依赖并健康的可持续发展

(4)通过投资构建生态和补齐 AGI 探索需要的技术伙伴

2021 年,OpenAI 宣布启动一个 1 亿美元的创业基金,名为 OpenAI Startup Fund。主要投资标的有以下几类:

应用层公司

初创企业可以在 OpenAI 公开发布新工具之前先使用新能力,这会让他们在竞争对手前占据优势。OpenAI 可以深度获得各类场景的数据或早期反馈。

未来的 LLM 生态不会只有 OpenAI 一个模型层玩家,而会有多家模型厂商和大量垂直应用。通过投资的强合作关系可以让 OpenAI 和它的合作伙伴们的飞轮更大且更快。

(1)应用层拿走 30%~40% 价值

根据 A16Z 对美国 LLM 创业调研,纯应用厂商毛利约 60%~80%,20%~40% 的营收用于推理和模型 fine-tuning;

应用厂商当前用户和营收增长迅速,当前已经多厂商 ARR 达 1 亿美金;

虽然用户数量和营收都在高速增长,但很多应用厂商都面临用户留存率低、竞争加剧和护城河浅等关键问题;

(2)模型层拿走 0%~10% 价值

根据 GPT-3.5 的模型参数量和价格测算,推测 OpenAI 几乎是以成本或极低的毛利对 API 定价。且根据对海外竞品 LLM 公司的访谈,竞品同类能力模型都在做推理成本优化以匹配 GPT-3.5 的价格(尚未达到);

未来纯模型厂商若模型能力与 OpenAI 的标准产品同质化,推理价格必然需要长期匹配有限盈利的 OpenAI 普惠大众的商业化策略。LLM 的训练成本又极高,纯模型厂商面临极大的商业化压力;

(3)计算基础设施服务层(计算硬件 云计算)拿走 50%~-70% 价值

推理上拿到 20%~40% 的价值;

训练成本极高:以当前的 A100 价格计算,千亿模型(GPT-3.5)训练成本约 2000 万人民币;在 LLM 进入多模态阶段后,预计 SOTA 的模型训练计算量增长会超过单位计算成本的下降速度,且短期内会有更多模型层玩家进入市场,预计 1~3 年内 LLM 的训练市场会增长迅速。

训练侧更多 LLM 玩家的入场及多模态模型进一步 Scale,推理侧 LLM 在进入爆发式增长起点,云计算和计算硬件市场将加速增长。云计算厂商行业格局可能发生较大变动。

(4)由于当前 LLM 生态在发展初期,开发者工具的生态位还不稳定,本文暂不展开讨论。

4.1.2 未来应用层高速增长且毛利可能改善,模型层竞争加剧,计算基础设施厂商将持续高速增长

需要注意的是,现阶段 LLM 仍处于大规模研发期,很多 LLM 新玩家才刚入场。且 LLM 在应用层的潜力还没有被挖掘,大规模渗透还没有开始,LLM 的训练成本未被摊销。因此云计算和硬件厂商成了这一时期的最大玩家。我们认为此时的价值链分布为 LLM 行业发展早期的状态。行业生态真正成型后的价值链分布将与现阶段大相径庭。

(1)应用层:随着 LLM 在各类应用场景的潜力被挖掘,应用层将加速增长。同时由于模型层竞争加剧可能导致的价格战,预期应用层毛利会改善。不过同质化的应用同样会导致价格战,这就要求应用层公司将壁垒建立在基础模型能力之外,我们认为能够差异化产品或建立网络效应的应用层公司会真正获得最大的产业链价值。

(2)模型层:OpenAI 的定价策略将会成为纯模型 API 的定价标准。预计 OpenAI 会坚持普惠大众的有限盈利商业化策略(如:2023 年 3 月 ChatGPT 降价 90% ),不具备显著技术优势的 LLM 公司靠卖模型 API 盈利预计会很艰难。只有真正掌握全球 SOTA 模型及成本控制能力的公司才掌握模型定价权。

3)计算基础设施服务层(计算硬件 云计算):训练推理双增长,全行业获得新的增长曲线。新的增长可能也是行业洗牌的机会,如何与 LLM 配合获得主动权对云计算厂商至关重要。同时要注意一些应用层公司或硬件层公司做新云的可能性。

在盘点了当前 LLM 生态的宏观格局后,我们放大讨论各个局部,开放式地提出一些值得探讨的话题。但是现在行业处于剧烈变化的阶段,我们基于当前的理解给出一观点,更多的是为了激发大家的讨论。

4.2 LLM 是否会进入价格战,模型层价格收否终将收敛到云计算的价格?

讨论这个问题前,首先需要提出两个问题:

(1)LLM 的价值点到底是什么?是 LLM 提供的信息获取、理解与推理能力,还是新的人机交互界面的革新?

前者模型的发展目标是进一步提升的复杂推理和高级智能能力。后者模型的当务之急是增加对人类任务的理解力,加强使用工具应用的可靠性和准确性。两者当前的模型发展重点是有细微分岔的。

(2)新入场的 LLM 公司的自我定位是什么?是探索 AI 智能极限的 AGI 公司,还是地域版的 OpenAI 镜面公司,还是商业化 LLM 公司?

我们认为现阶段,复刻 GPT-3.5 和 ChatGPT 本质是工程问题,复刻 GPT-4 以后的 OpenAI SOTA 模型需要的则是算法科研能力。而要探索 AGI,则需要极强的技术洞见,独立的技术判断(OpenAI 不一定是正确答案),真正的 AGI 信仰和长期有耐心。

不可否认,GPT-3.5 和 ChatGPT 就已经具备充分的商业化潜力了。

但是我们认为从模型能力角度,GPT-3.5 和 ChatGPT 级别的模型能力将在 1~2 年在各个 LLM 团队内拉平。如果公司的模型能力停留在这个水平,模型 API 的价格战不可避免,终将趋向于成本。而真正能独占性地持续迭代出 SOTA 模型的厂商才能掌握定价权。

另一方面从产品形态角度,API本身不会成为平台,只会成为通道。以 AGI 模型能力为基础打造具有聚合能力的平台型产品,占据有利的生态位,才可能摘取更多的价值。

需要声明的是,长期来看,我们不认为这一波 AI 浪潮的价值都会被基础设施厂商消化。与国内 2010 年后的第一波 CV(Computer Vision)浪潮不同,现今 LLM 的下游高价值场景非常发散,并不会收敛到 1~3 个(人脸识别在安防、身份认证等)标准场景上。LLM 模型层将获得更多溢价。

4.3 路径不同的 LLM 公司是会分岔还是收敛?

如上个问题所述,不同自我定位和目标的 LLM 公司会在下一个赛段短期内分岔发展。而长期的工作需要时间才会有阶段性成果(GPT 路线走了 5 年)。

我们认为 LLM 模型发展发向很有可能是一个“收敛-发散-再收敛”的过程。短期工作有很多会收敛,接下来在垂直领域会分岔,当长期工作有了阶段性成果后会再收敛。

4.4 LLM:开源 VS 闭源?

观察文生图领域,Stable Diffusion 和 MidJourney 仍然在拉锯竞争。而 LLM 领域, LLaMA LoRA 项目遍地开花,人人都可以训练一个大模型。两个生态会如何演化?

我们提供一个分析角度:开源本质是产品研发和 GTM 的一种方式。社区的活跃程度不能等同于商业价值。对于 LLM 的研发,开源是否能提供闭源不具备的价值?无论 GTM 的路径是什么,客户最后买单的是产品价值。开源闭源产品能力或服务体验是闭源产品无法满足的?

4.5 计算基础设施层的增量会有多大?是否有新云的机会?

2023 年 4 月 5 日, ChatGPT Plus 停止新的付费注册,据称是因为微软的计算资源不够了。不管消息是否属实,LLM 已经并且将持续增加对计算基础设施的需求显而易见,甚至可能导致云计算行业的洗牌。关于AI对于云计算的增量有多大,取决于人类在比特世界的活动会多大程度被 AI 渗透。这需要对模型能力进行预测及对每个细分场景进行分析,今天暂不详细展开。

英伟达 2023 年 3 月的 GTC 大会发布的四款推理平台中,H100-NVL(2卡,显存94GB*2HBM3)——为什么不是 80G(单卡平台的显存)*2?因为放不下GPT-3 176B 的参数量。同时,英伟达发布 DGX Cloud 产品,企业可以直接租用集群进行各类 AI 模型训练和 fine-tune,消除了部署和搭建基础设施的复杂性,越过了传统云计算厂商。这让我们不禁怀疑,AI 带来巨大计算增量是不是让英伟达燃起了做云计算的野心?

另一个角度,真正远超竞争对手模型能力的 LLM 公司,是否有机会向下延伸,打出一朵新云?正如前文分析,计算基础设施是当前生态中确定性最高的可持续获利且有壁垒的的环节。如果 SOTA LLM 和某家云服务独家绑定,下游客户对 SOTA LLM 的粘性很可能高于云服务商,这里的潜在机会非常值得深入研究。

毋庸置疑的是,无论是新老玩家,与 LLM 的竞和战略对云计算服务厂商至关重要(就在发文当天,AWS 发布 Amazon Bedrock,正式加入战局)。

4.6 下游应用和工具是否有稳定的生存空间

Jasper 和 Langchain 的遭遇引发了创业者的巨大争论:能力快速升级的 OpenAI 会不会逐步蚕食下游应用和工具的生存空间?

我们认为创业者可以拆成 2 层看这个问题:

(1)问题1: AGI 不停升级的基础模型能力,是否会自然覆盖我的产品核心竞争力?

如果产品的核心竞争力完全是模型能力的浅层封装,公司的生存空间自然不稳定。应用层公司应努力构建自有业务的网络效应或数据积累。以 Jasper 举例,如果公司能够将核心产品竞争力从单一的“智能化营销内容生产”转为“最智能的 All-in-One 营销平台”,那与 ChatGPT 的竞争担心就会大大减弱。当然这就让 Jasper 面临和 Salesforce、Hubspot 等传统营销平台的竞争。各个垂直场景新老玩家谁能胜出,也是一个值得展开研究的话题。

(2)问题2: OpenAI 为了不断发展 AGI,是否希望获得我场景中的数据?

这个问题就回到了两个数据飞轮间的博弈,且不仅仅是技术的博弈。OpenAI 会持续希望获得自己模型没有学习过的非同质化有效数据。

Langchain 的场景拥有 OpenAI 希望获得的“开发者通过使用各类工具构建应用,来完成用户任务”的数据,而场景高度依赖 GPT 生态,自然场景和数据都被 OpenAI 回收了;

Bloomberg 则不然。我们相信拿 Bloomberg 的数据 fine-tune GPT 模型,无论是效果还是成本都会优于 BloombergGPT。但 Bloomberg 掌握了金融的深度场景、量足够大且足够独特的私有数据,便掌握了和 OpenAI 博弈的能力。当然另一个层面的囚徒困境是:如果你选择不拥抱通用模型生态,是否会输给搭建于大模型之上的竞争对手?

4.7 模型层与应用层的价值分配

首先,由于 OpenAI 实际掌握了 LLM 模型的行业定价权,基于我们对 OpenAI 会持续追求普惠 AGI 愿景和有限盈利架构的判断,我们认为 OpenAI 不会主观侵占下游应用的利润空间。

那么当底层 LLM 模型的参数量逐年上升,模型的推理成本会不会让上游应用无法承受?

我们判断不会。因为不同智能含量的场景,需要的模型能力和能承受的模型价格都是不同的。举例来说,写 10 条小红书的营销文案可能需要月工资 5000 元的员工 1 小时,而 10 条跨国法律合同修改意见则需要小时工资 400 美元的海外律师 1 小时。二者对模型成本的敏感性显然差很多。

4.8 C 端的超级流量入口?平台还是管道(Platform VS Pipeline)?

OpenAI 无疑展现了新一代 C 端流量入口的潜力。然而流量可以成为管道也可以成为平台,二者的商业价值不可同日而语。

正如 Packy McCormick 在 Attention is All You Need 文章中指出,OpenAI 率先吸引了Attention with Intelligence。ChatGPT 现在已经和亿级用户建立了直接的联系,为服务用户提供了较低的边际成本,且可以以递减的边际成本获得需求驱动的多方网络效应,成为了一个最有潜力的超级 C 端聚合平台。Plugin 的交互界面和传统 API 完全不同,对 C 端可能产生更深远的影响,今天暂不展开。

同时 Google 仍然不容小觑,最近 Bard 将底层模型替换成 PaLM 后,能力大幅提升。当前 Bard 和 ChatGPT 相比,仍然很 Nerdy。但是我们预期,以 Google 的技术深度和各类 10 亿量级用户的 C 端产品,它充分具备打造新一代以 LLM 为基础的新一代 C 端聚合平台的潜力。

相比之下,Anthropic 的 Claude 被认为具备 ChatGPT 同等水平的智能,其平台潜力却远没有被激发出来。

并不是所有 LLM 追随者都能成功复刻 GPT 模型 ChatGPT Plugin 路径的。正如前文分析 OpenAI 今天的成就是技术 产品 GTM 综合的结果。即使如中国般相对独立的区域市场,也需要真正领先的技术能力与战略能力结合才能成功。

写在最后

以上是 OneMoreAI 根据原报告整理的压缩版,报告原文中除了对上文提到的信息有更深入和具体的分析外,也留下了很多问题待进一步研究和讨论。

LLM 行业还在起步阶段,生态仍未稳定,未来充满了不确定性。我们从逆向工程 OpenAI 的思路出发,尝试解释并预测行业最关键玩家的行为,希望建立一个能够对 LLM 生态进行系统性讨论的宏观框架供大家讨论,一起迎接这个历史性的 AI 浪潮。

Reference:

Introducing OpenAI https://openai.com/blog/introducing-openai

Planning for AGI and Beyond https://openai.com/blog/planning-for-agi-and-beyond

Generative models https://openai.com/research/generative-models

Unsurpervised Sentiment Neuron https://openai.com/research/unsupervised-sentiment-neuron

Improving Language Understanding by Generative Pre-Training https://cdn.openai.com/research-covers/language-unsupervised/language_understanding_paper.pdf

Language Models are Unsupervised Multitask Learners https://cdn.openai.com/better-language-models/language_models_are_unsupervised_multitask_learners.pdf

Language Models are Few-Shot Learners https://arxiv.org/abs/2005.14165

OpenAI LP https://openai.com/blog/openai-lp

Aligning language models to follow instructions https://openai.com/research/instruction-following

Training Language Models to Follow Instructions with Human Feedback https://arxiv.org/abs/2203.02155

ChatGPT https://openai.com/blog/chatgpt

GPT-4 Technical Report https://cdn.openai.com/papers/gpt-4.pdf

https://openai.com/blog/chatgpt-plugins

PaLM API https://blog.google/technology/ai/ai-developers-google-cloud-workspace/

LLaMA: Open and Efficient Foundation Language Models https://arxiv.org/abs/2302.13971

Alpaca: A Strong, Replicable Instruction-Following Model https://crfm.stanford.edu/2023/03/13/alpaca.html

Vicuna: An Open-Source Chatbot Impressing GPT-4 with 90%* ChatGPT Quality https://vicuna.lmsys.org/

Compression for AGI - Jack Rae | Stanford MLSys #76 https://www.youtube.com/watch?v=dO4TPJkeaaU&t=247s

AI Today and Vision of the Future (Ilya Sutskever interviewed by NVIDIA's Jensen Huang) https://youtu.be/ZZ0atq2yYJw

OpenAI Meta-Learning and Self-Play https://www.youtube.com/watch?v=9EN_HoEk3KY

Minds, brains, and programs https://www.cambridge.org/core/journals/behavioral-and-brain-sciences/article/abs/minds-brains-and-programs/DC644B47A4299C637C89772FACC2706A

Mastering the game of Go with deep neural networks and tree search https://storage.googleapis.com/deepmind-media/alphago/AlphaGoNaturePaper.pdf

Highly accurate protein structure prediction with AlphaFold https://www.nature.com/articles/s41586-021-03819-2

Improving alignment of dialogue agents via targeted human judgements

https://arxiv.org/pdf/2209.14375.pdf

https://alphacode.deepmind.com/

Aligning language models to follow instructions https://openai.com/research/instruction-following

Constitutional AI: Harmlessness from AI Feedback https://arxiv.org/pdf/2212.08073.pdf

Evaluating Large Language Models Trained on Code https://arxiv.org/pdf/2107.03374.pdf

GPT-4 Technical Report

https://cdn.openai.com/papers/gpt-4.pdf

OpenAI Triton

https://github.com/openai/triton

BloombergGPT: A Large Language Model for Finance https://arxiv.org/pdf/2303.17564.pdf

https://www.reuters.com/technology/microsoft-talks-invest-10-bln-chatgpt-owner-semafor-2023-01-10/

Technology and wealth inequality

https://blog.samaltman.com/technology-and-wealth-inequality

Introducing Claude

https://www.anthropic.com/index/introducing-claude

Who Owns the Generative AI Platform?

https://a16z.com/2023/01/19/who-owns-the-generative-ai-platform/

本文来自微信公众号:OneMoreAI(ID:OneMoreAI1956),作者:Kiwi

本内容为作者独立观点,不代表虎嗅立场。未经允许不得转载,授权事宜请联系 hezuo@huxiu.com

正在改变与想要改变世界的人,都在 虎嗅APP

猜你喜欢