编辑:拉燕

【新智元导读】LeCun昨天在一场辩论中再贬ChatGPT!形容这个AI模型的智力连狗都不如。图灵三巨头之一的LeCun昨日又爆金句。

「论聪明程度,ChatGPT可能连条狗都不如。」

这句话来自本周四LeCun在Vivatech上和Jacques Attalie的一场辩论,可谓精彩纷呈。

不过,LeCun一贯的观点都是——不必太过紧张,如今的AI智能水平远远没到我们该担忧的地步。

而其他的科技巨头则基本和LeCun持截然相反的意见。

比如同为图灵三巨头的Hinton和Bengio,以及AI届人士由Sam Altman挑头签的公开信,马斯克的危机言论等等。

在这种大环境下,LeCun一直「不忘初心」,坚定认为现在真没啥可担心的。

LeCun表示,目前的生成式AI模型都是在LLM上训练的,而这种只接受语言训练的模型聪明不到哪去。

「这些模型的性能非常有限,他们对现实世界没有任何理解。因为他们纯粹是在大量文本上训练的。」

而又因为大部分人类所拥有的知识其实和语言无关,所以这部分内容AI是捕捉不到的。

LeCun打了个比方,AI现在可以通过律师考试,因为考试内容都停留在文字上。但AI绝对没可能安装一个洗碗机,而一个10岁的小孩儿10分钟就能学会怎么装。

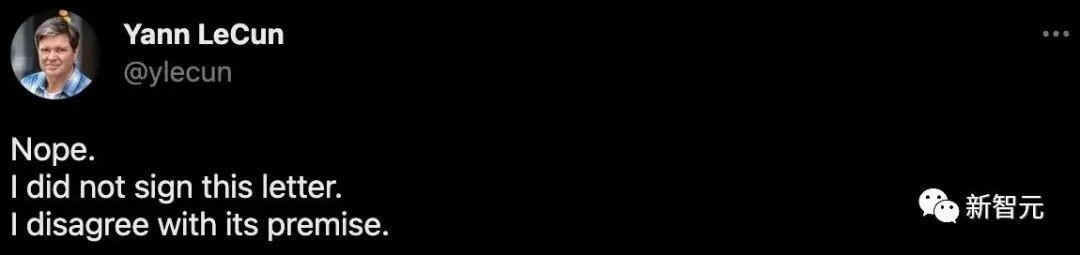

当然,公开信LeCun也是压根没搭理,发推高调表示哥们儿没签。

「依靠自动回归和响应预测下一个单词的LLM是条歪路,因为它们既不能计划也不能推理。」

当然,LeCun是有充分的理由相信这一点的。

ChatGPT这种大语言模型是「自回归」。AI接受训练,从一个包含多达14000亿个单词的语料库中提取单词,预测给定句子序列中的最后一个单词,也就是下一个必须出现的单词。

Claude Shannon在上个世纪50年代开展的相关研究就是基于这一原则。

原则没变,变得是语料库的规模,以及模型本身的计算能力。

LeCun表示,「目前,我们无法靠这类模型生成长而连贯的文本,这些系统不是可控的。比如说,我们不能直接要求ChatGPT生成一段目标人群是13岁儿童的文本。

其次,ChatGPT生成的文本作为信息来源并不是100%可靠的。GPT的功能更像是一种辅助工具。就好比现有的驾驶辅助系统一样,开着自动驾驶功能,也得把着方向盘。

而且,我们今天所熟知的自回归语言模型的寿命都非常短,五年算是一个周期,五年以后,过去的模型就没有人再会用了。

而我们的研究重点,就应该集中在找到一种是这些模型可控的办法上。换句话说,我们要研究的AI,是能根据给定目标进行推理和计划的AI,并且得能保证其安全性和可靠性的标准是一致的。这种AI能感受到情绪。」

要知道,人类情绪的很大一部分和目标的实现与否有关,也就是和某种形式的预期有关。

而有了这样的可控模型,我们就能生成出长而连贯的文本。

LeCun的想法是,未来设计出能混合来自不同工具的数据的增强版模型,比如计算器或者搜索引擎。

像ChatGPT这样的模型只接受文本训练,因此ChatGPT对现实世界的认识并不完整。而想要在此基础上进一步发展,就需要学习一些和整个世界的感官知觉、世界结构有关的内容。

然而好玩儿的是,Meta自己的模型galactica.ai上线三天就被网友喷的查无此人了。

原因是胡话连篇。

笑。

参考资料:

https://www.cnbc.com/2023/06/15/ai-is-not-even-at-dog-level-intelligence-yet-meta-ai-chief.html

相关文章

猜你喜欢