衡宇 发自 凹非寺量子位 | 公众号 QbitAI

“套壳ChatGPT!”“套皮Stable Diffusion!”“实则抄袭!”……

外界对国产大模型产生质疑已经不是一次两次了。

业内人士对这个现象的解释是,高质量的中文数据集实在紧缺,训模型时只能让采买的外文标注数据集“当外援”。训练所用的数据集撞车,就会生成相似结果,进而引发乌龙事件。

然而这样喂养出的大模型始终是英文思维,当遇到成语改写、俗语理解、文章改写这类含有中文语言特色的内容,往往处理不佳,出现翻译错误或潜在文化的偏差。

还有个解决办法就是采集、清洗和标注中文语料,做新的中文高质量数据集,供给给大模型们。

开源数据集众人拾柴察觉现况后,国内不少大模型团队决定走第二条路,着手利用私有数据库做数据集。

百度有内容生态数据,腾讯有公众号数据,知乎有问答数据,阿里有电商和物流数据。

积累的私有数据不一,就可能在特定场景和领域建立核心优势壁垒,将这些数据严格搜集、整理、筛选、清洗和标注,能保证训出模型的有效性和准确性。

而那些私有数据优势不那么明显大模型团队,开始全网爬数据(可以预见,爬虫数据量会非常大)。

当更多的中文数据集被开源到聚光灯下,行业的态度是欢迎与欣喜。如智谱AI创始人兼CEO张鹏表达出的态度:

中文高质量数据只是被藏在深闺而已,现在大家都意识到这个问题了,自然也会有相应的解决方案,比如数据开源。总之是在向好的方向发展,不是吗?

值得注意的是,除了预训练数据,目前阶段人类反馈数据同样不可或缺。

现成的例子摆在眼前:

与GPT-3相比,ChatGPT叠加的重要buff就是利用RLHF(人类反馈强化学习),生成用于fine-tuing的高质量标记数据,使得大模型向与人类意图对齐的方向发展。

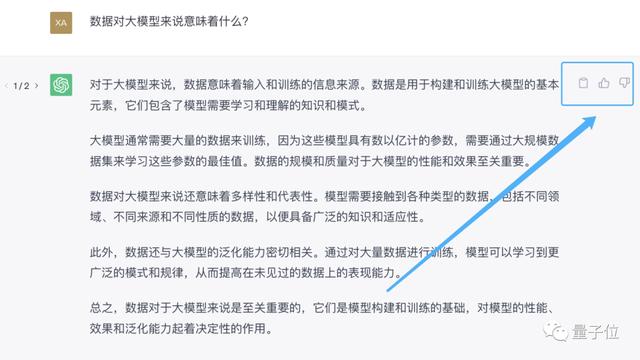

提供人类反馈最直接的办法,就是告诉AI助手“你的回答不对”,或者直接在AI助手生成的回复旁边点赞或踩一踩。

先用起来就能先收集一波用户反馈,让雪球滚起来,这就是为什么大家都抢着发布大模型的原因之一。

现在,国内的类ChatGPT产品,从百度文心一言、复旦MOSS到智谱ChatGLM,都提供了进行反馈的选项。

但由于在大部分体验用户眼中,这些大模型产品最主要的还是“玩具”属性。

当遇到错误或不满意的回答,会选择直接关掉对话界面,并不利于背后大模型对人类反馈的搜集。

So~

今后遇到AI生成回答有错误或遗漏时,

请不要吝惜一次点击,高举你手中的

,让大模型能收集更多的人类反馈。

就像读到这里,不要吝惜对这篇推文点赞、转发、在看一样!(doge)

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

相关文章

猜你喜欢